技术巡猎 蔚来 流式空间音频分离方法、设备及车载音频系统---车载音响的好坏,真的只看喇叭数量和功放功率吗?这些当然重要,但还不是根本。真正决定一套车载音响能有多强的,是它能不能"实时听懂"正在播放的音乐。

音乐和语音完全是两码事。

语音通常就是一个人说话,结构相对单纯;音乐里却是鼓、贝斯、人声、和声、泛音、空间反射全部叠在一起,频率跨度大,层次也复杂得多。现在市面上的方案有几个老大难问题:一是计算量太大,车载芯片这种资源有限的平台根本跑不动实时处理;二是分离之后,高频细节和空间层次容易丢信息;三是太依赖长缓存,延迟和内存占用都蹭蹭往上涨。

蔚来的解法,关键就在"流式"这两个字。不是先把整首歌拿下来离线分析完再处理,而是音频流一边进来一边处理。专利里提到会把音频按帧长切成多个小块,比如20到40毫秒一段,然后对每一段做时域特征提取和短时傅里叶变换。打个比方,系统不是拿着整部电影慢慢研究剧情,而是像个反应极快的现场导演,每几十毫秒就判断一次这一小段里谁才是真正的主角。

也不是所有频段一锅端,不同频段会区别对待。低频段重点抓节奏,比如鼓点和贝斯;中频段重点保旋律和和声;高频段则尽量留住泛音、细节和空间反射。这个思路和造车差不多,底盘、动力、车身,不可能一套参数管到底,必须分系统做调整,音乐也一样,低频是骨架,中频是主体,高频是空气感和层次感。

但光分频还不够,车上算力毕竟有限。所以这份专利又加了一层"自回归分频压缩",统不会死板地用同一把尺子去处理所有的音乐,也会根据上一刻的结果、当前音乐结构的变化,动态调整压缩力度。它会结合历史压缩特征、当前残差、谱能量、谱熵和不同频段的感知权重来更新压缩系数,形成一个不断自我修正的闭环。

接下来是这份专利真正见功夫的地方:长时序依赖建模。音乐不是简单地把几帧拼起来,很多好听的地方在于它是连续的。鼓点之后的人声起伏,副歌里的和声铺垫,甚至大厅混响的拖尾,都是有上下文关系的。专利这里用了层次化建模,底层用卷积增强注意力,高层用稀疏注意力,还做了局部和全局双通路。总之,它想同时兼顾"眼前这一拍"和"前后这一段",既保证瞬时细节,也保证长时间听下来空间感不会乱、和声不会断。

然后又补了一手,残差重构和残差压缩。因为流式处理最大的麻烦,就是每一小块都像独立切片,切不好声音就会出现断裂,尤其高频最容易发毛。专利会把前一时刻缓存下来的压缩特征和当前特征融合,补偿分块和压缩过程中丢掉的细节,特别是高频谐波结构和空间定位信息;同时把当前这块的关键信息继续压缩缓存,传给下一块。

你也可以理解成接力跑,并不是每一棒都从零开始,而是上一棒把最有价值的信息交给下一棒。这样做的结果,就是既可以降低延迟,又可以尽量保住连续性和沉浸感。

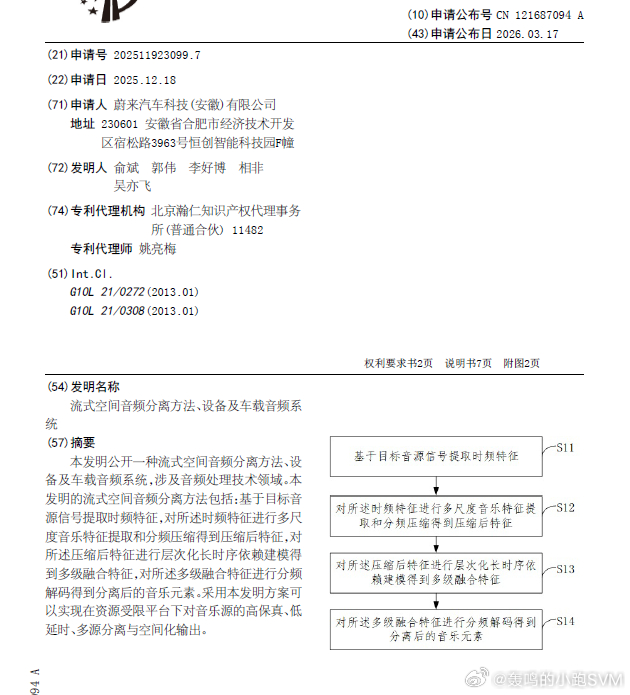

在车规约束下,试图同时搞定四件互相矛盾的事:实时、低算力、高保真、空间化,是这个专利的意义。最后落地的系统结构也很清晰,由特征提取、分频压缩、长时序依赖建模和分频解码这几个模块组成。

好音响有系列底层算法的,对吧?