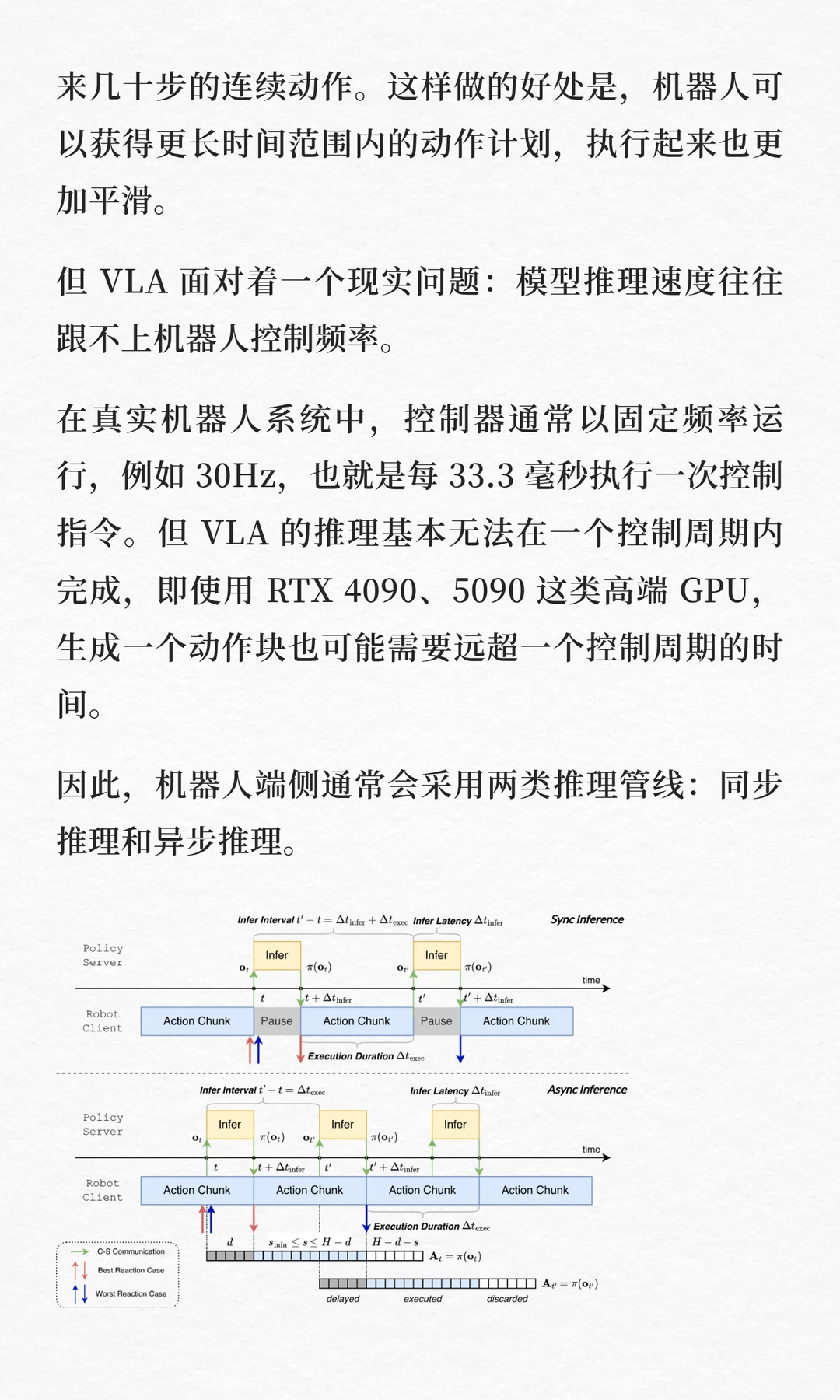

具身智能正以前所未有的速度发展,VLA 模型展现出越来越强的动作和泛化能力。然而,当我们真正把 VLA 模型部署到物理世界时,一个核心挑战浮出水面:实时性。

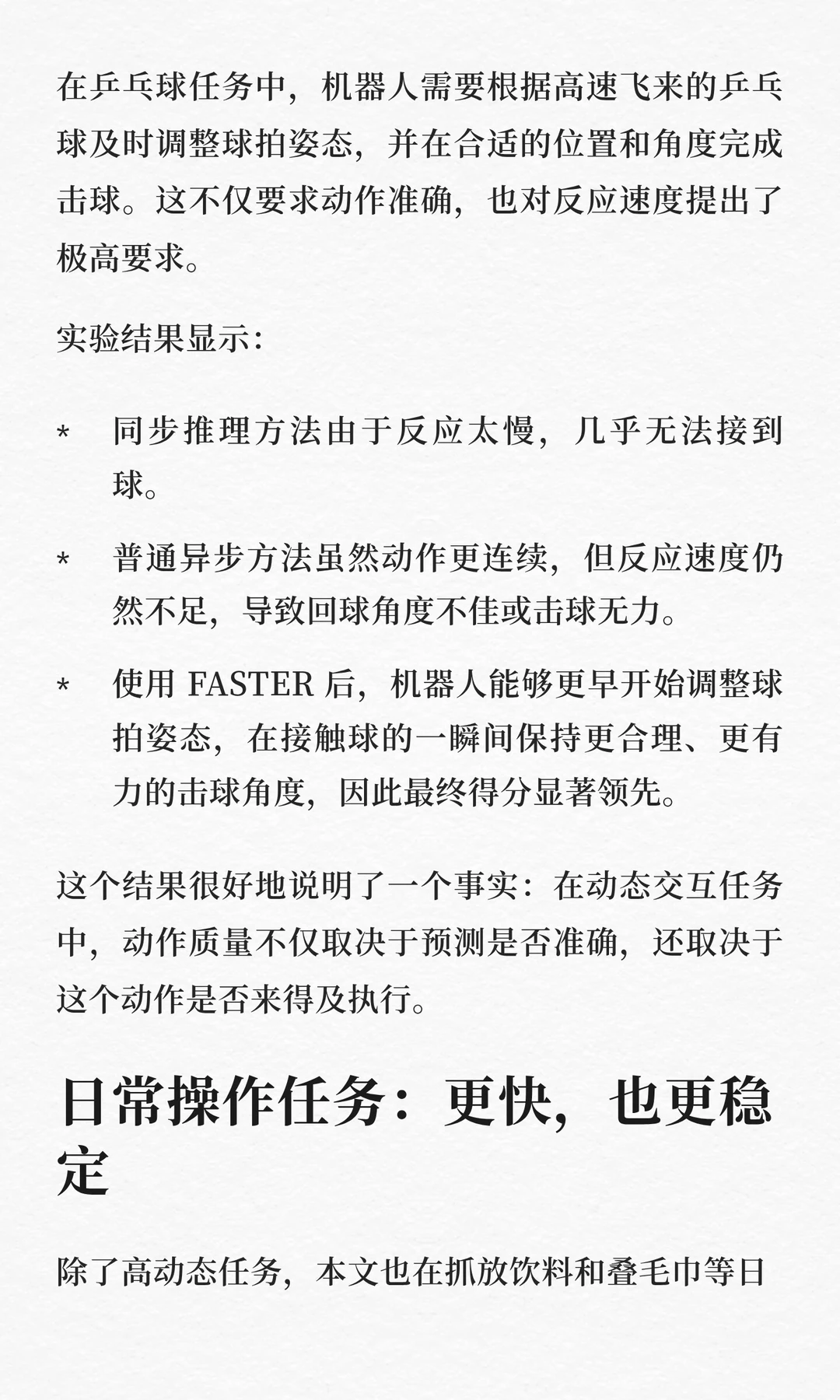

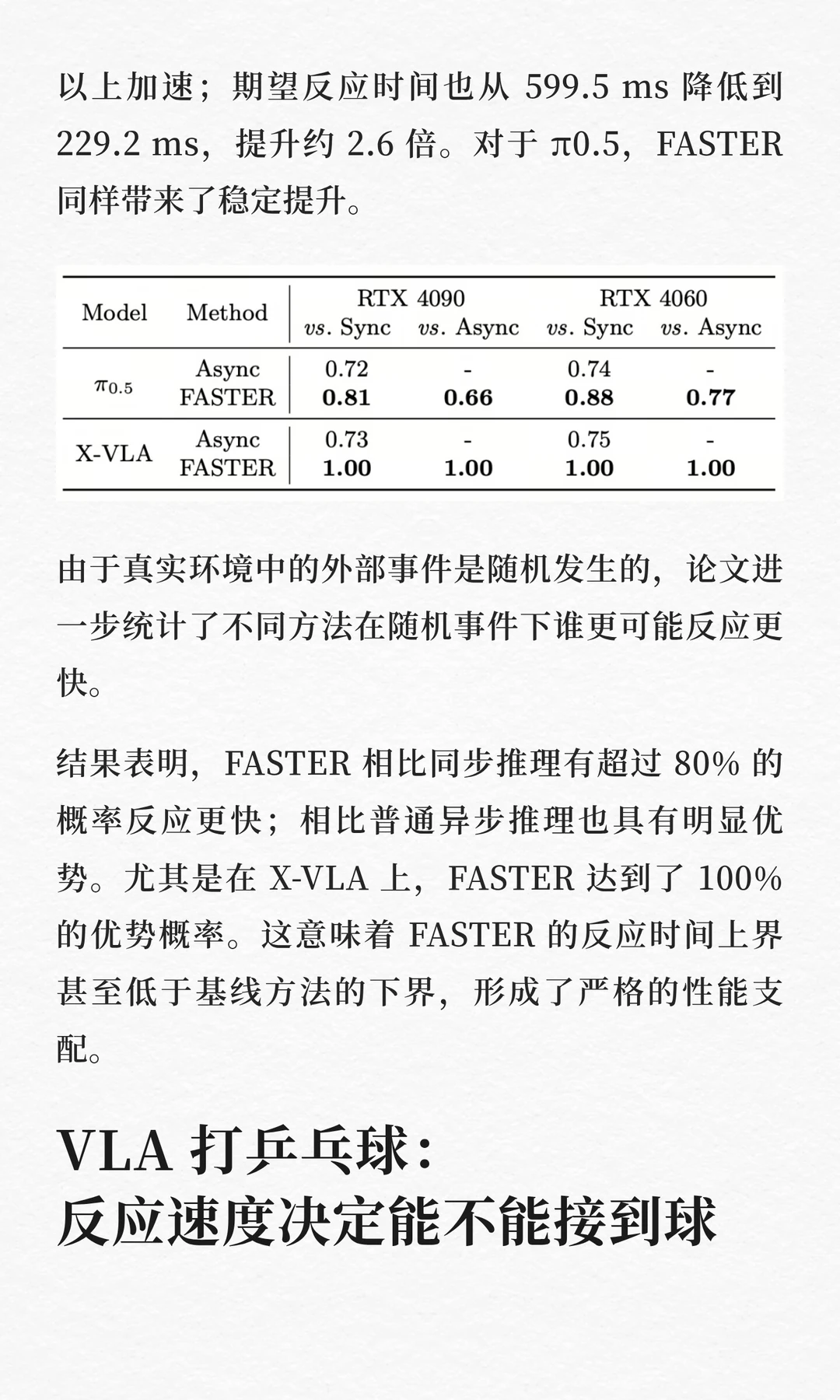

想象一下让机器人打乒乓球:球高速飞来时,哪怕只有 100 毫秒的延迟,也可能意味着错过最佳击球时机。对于真实世界中的机器人来说,动作不仅要「做得准」,还必须「反应得快」。

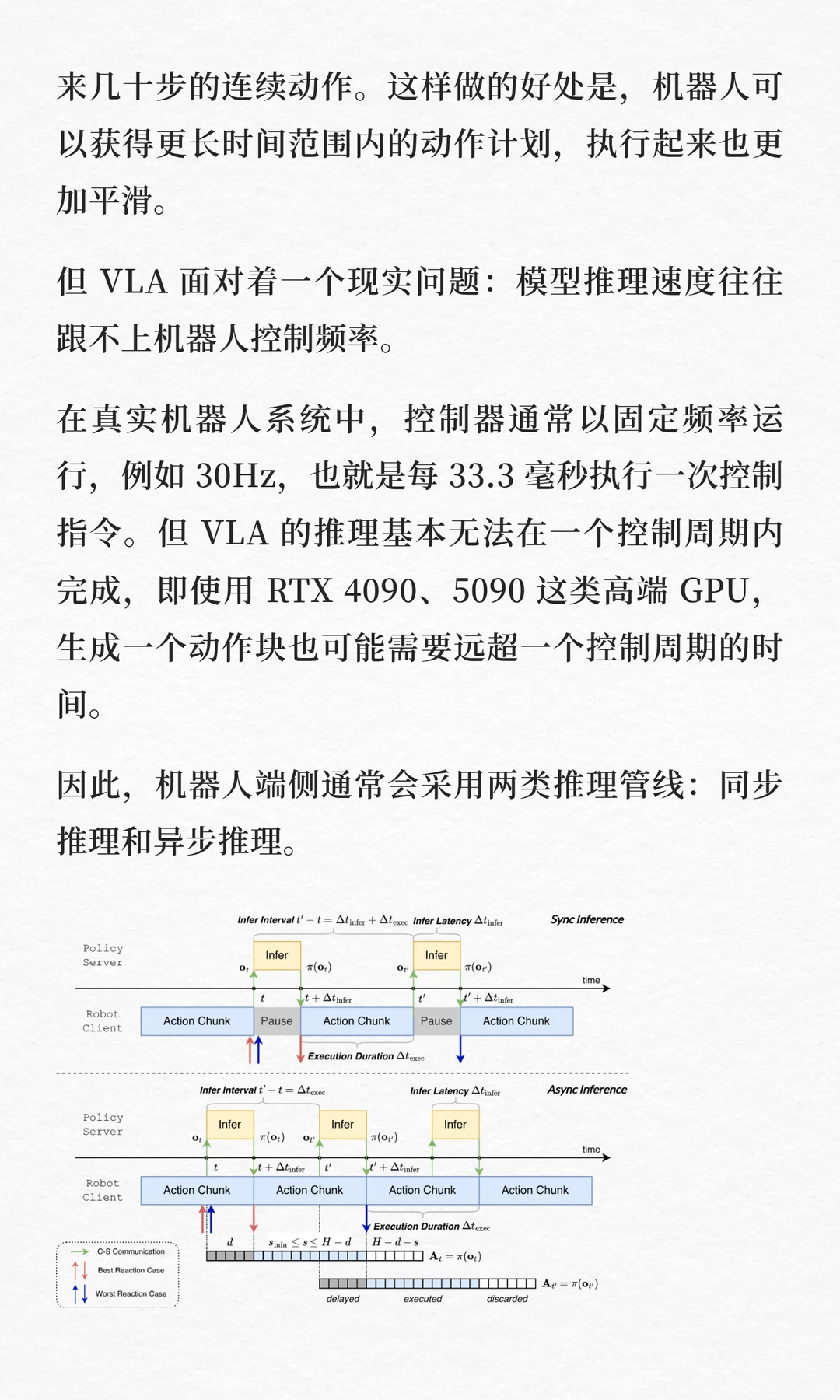

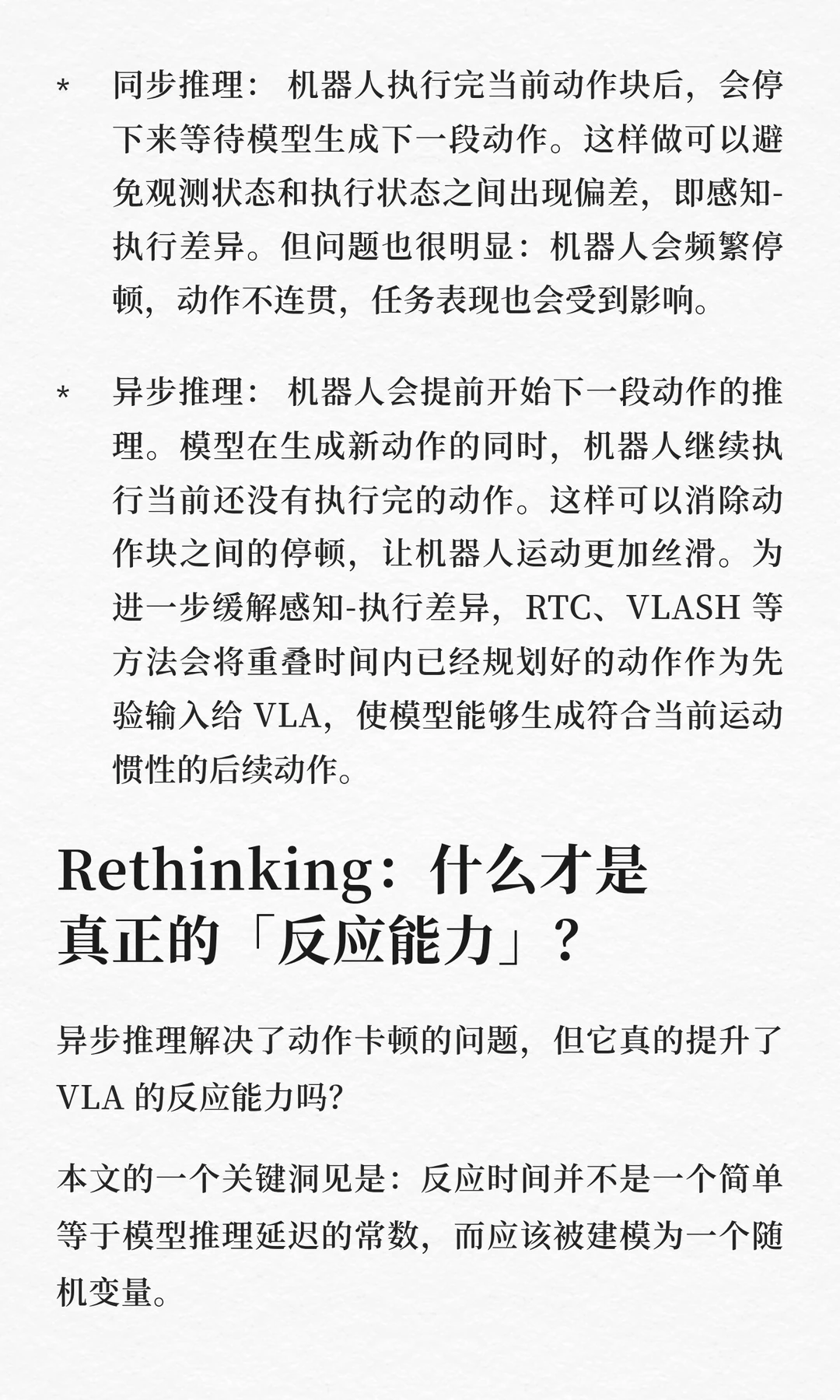

现有实时 VLA 方法大多关注如何让动作更连续、更平滑。但这些方法往往忽略了动态环境中更关键的一点:机器人到底能多快根据新变化做出反应?

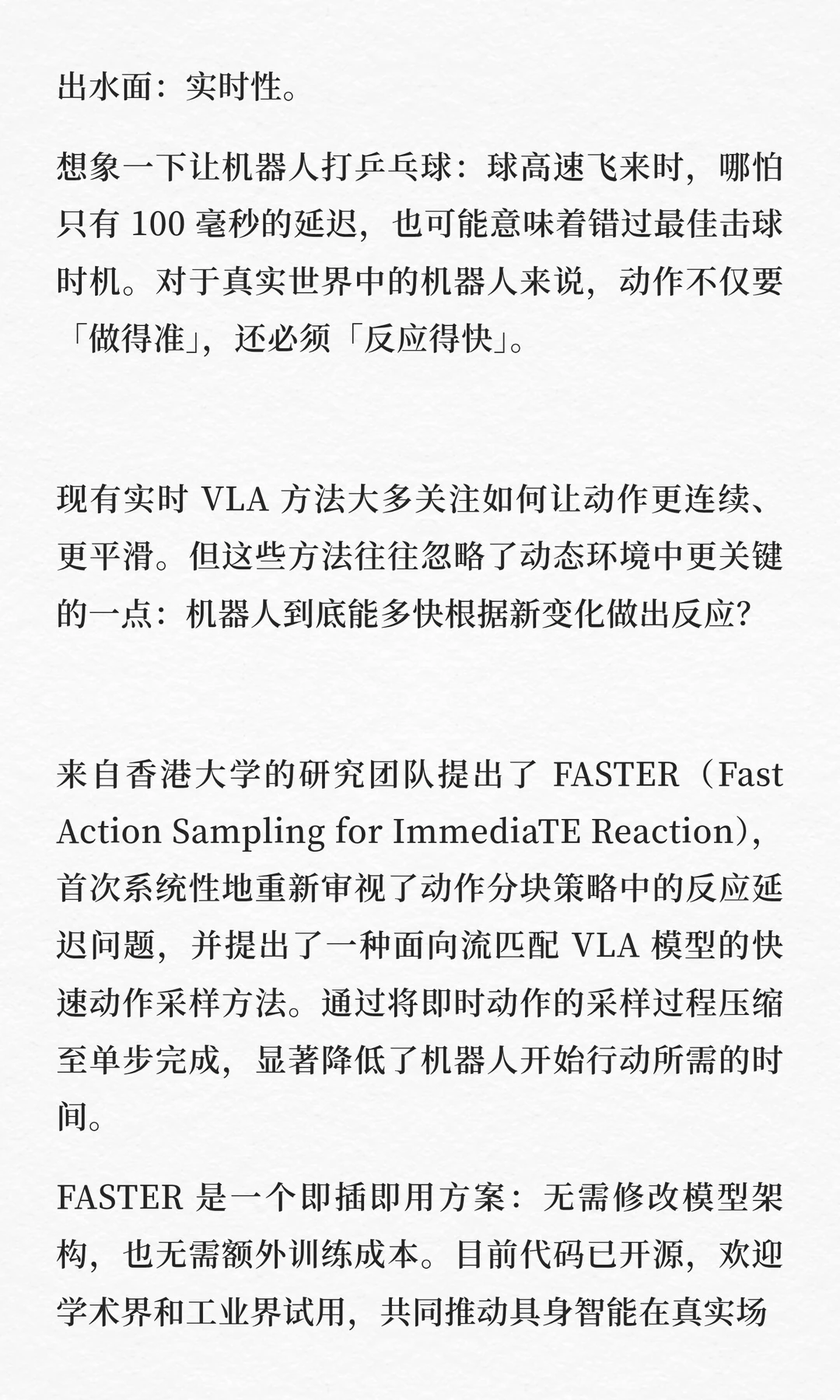

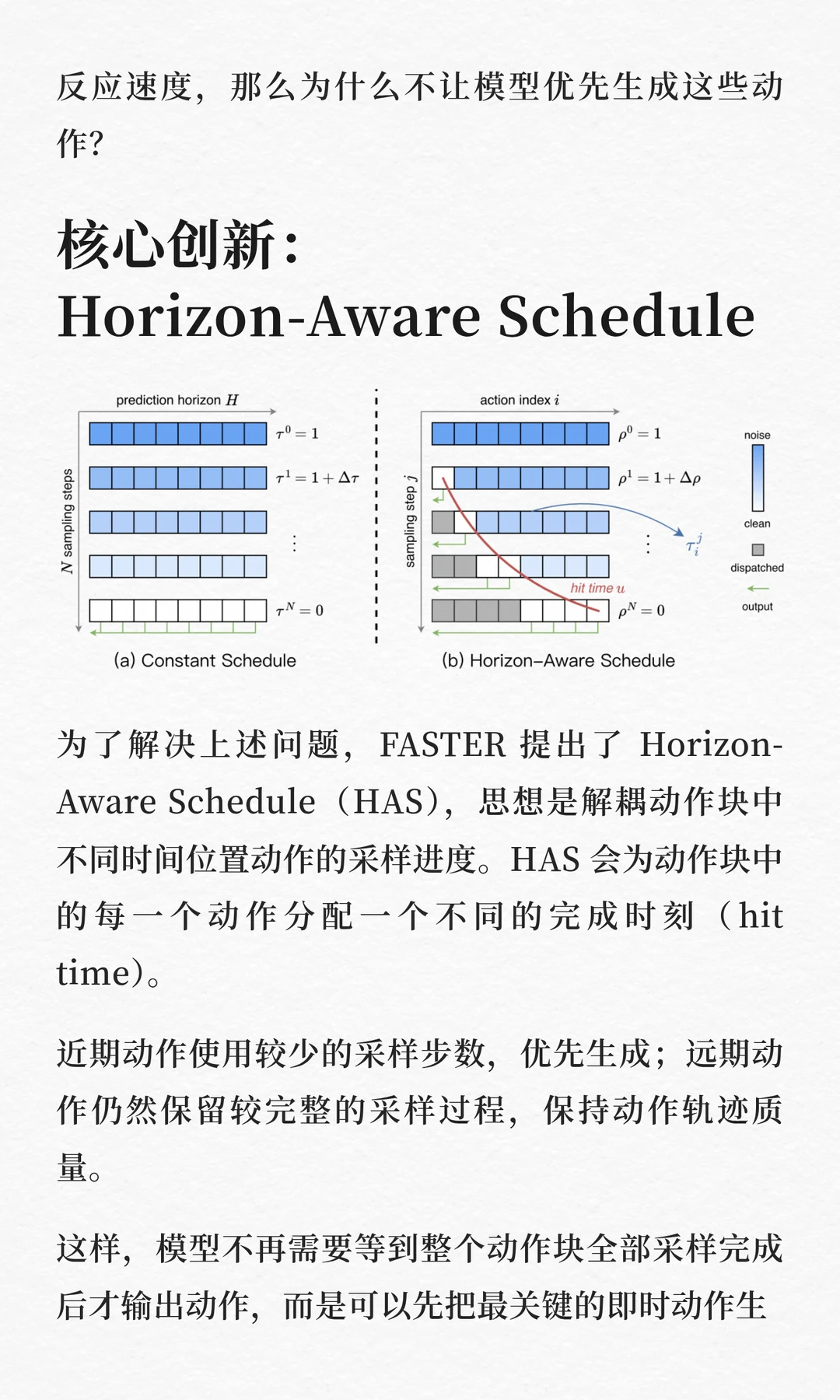

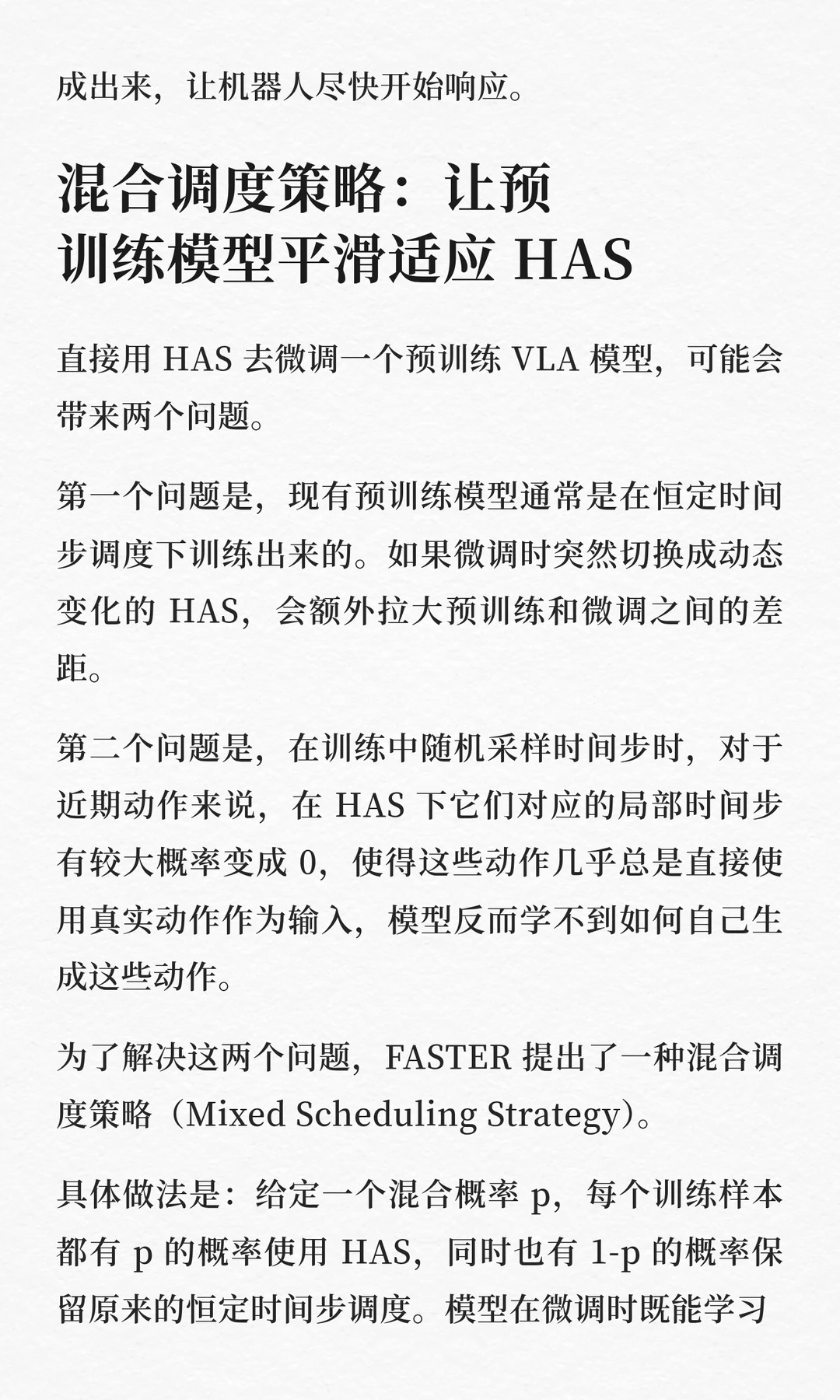

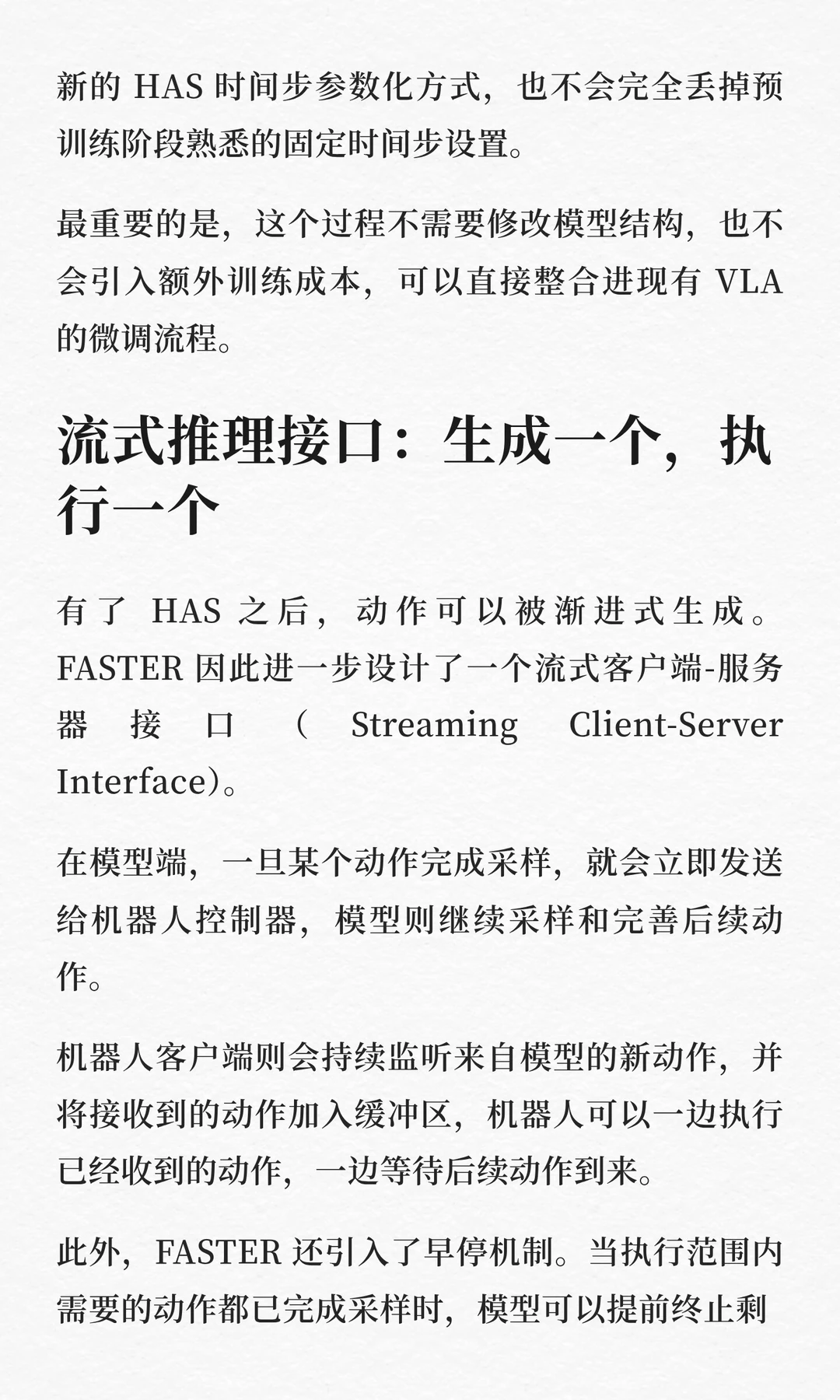

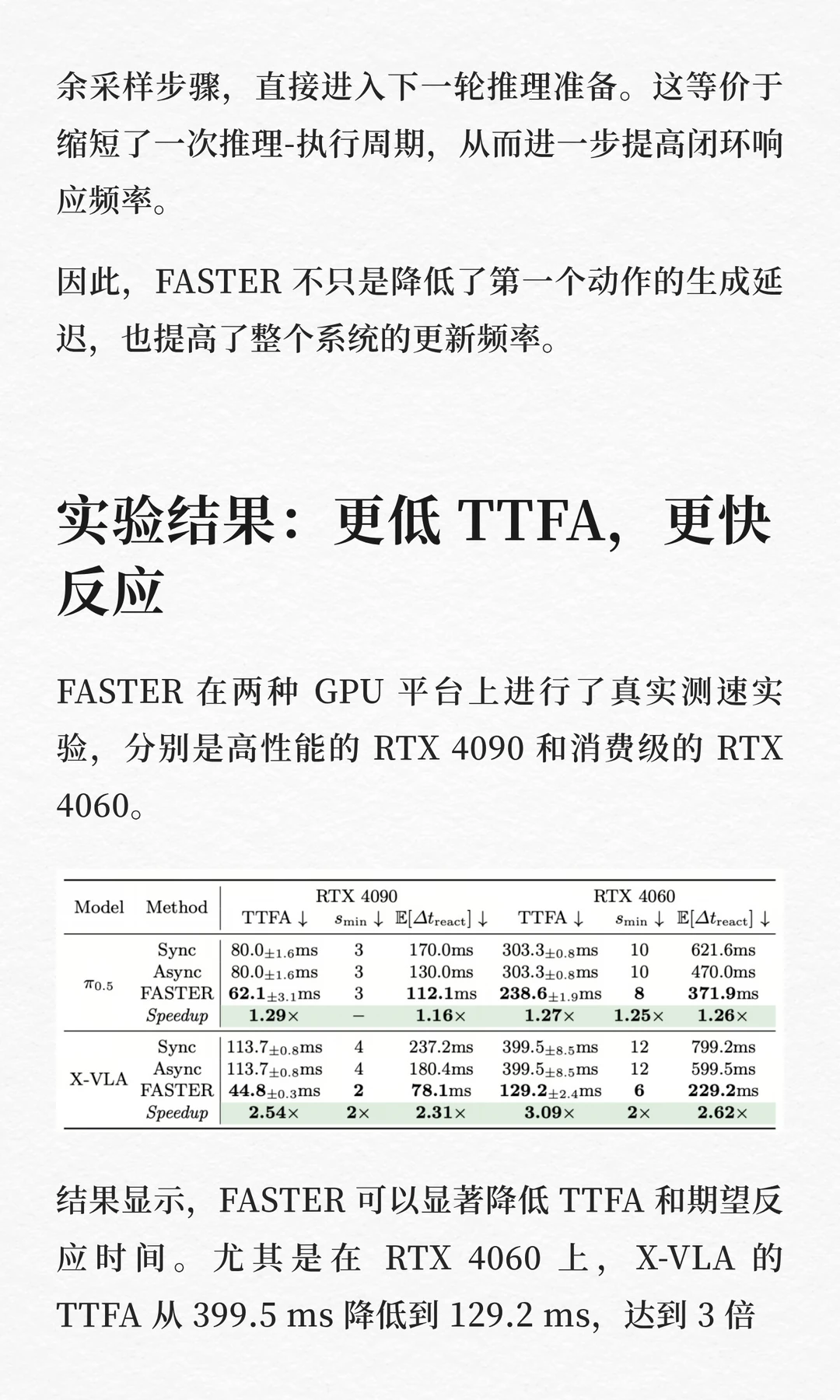

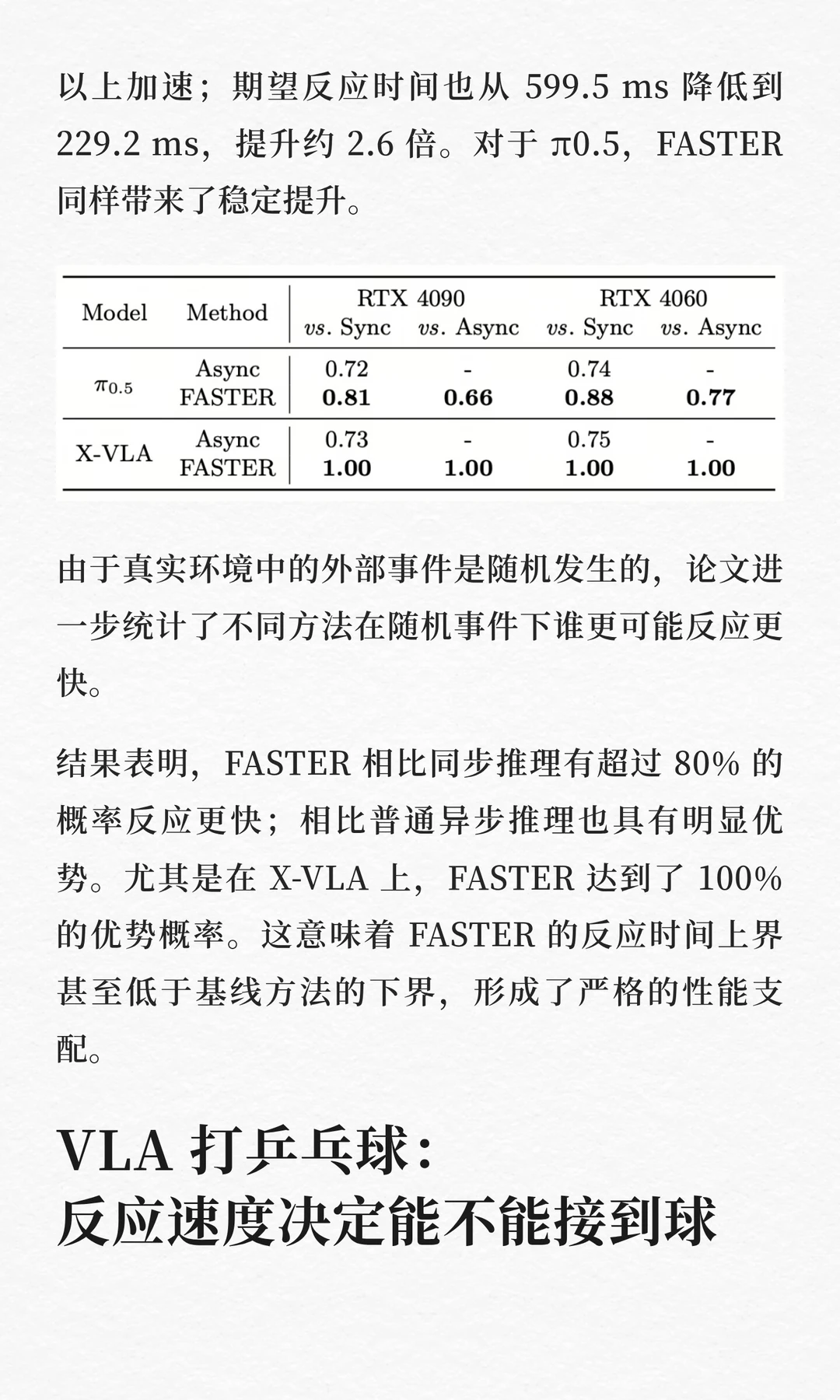

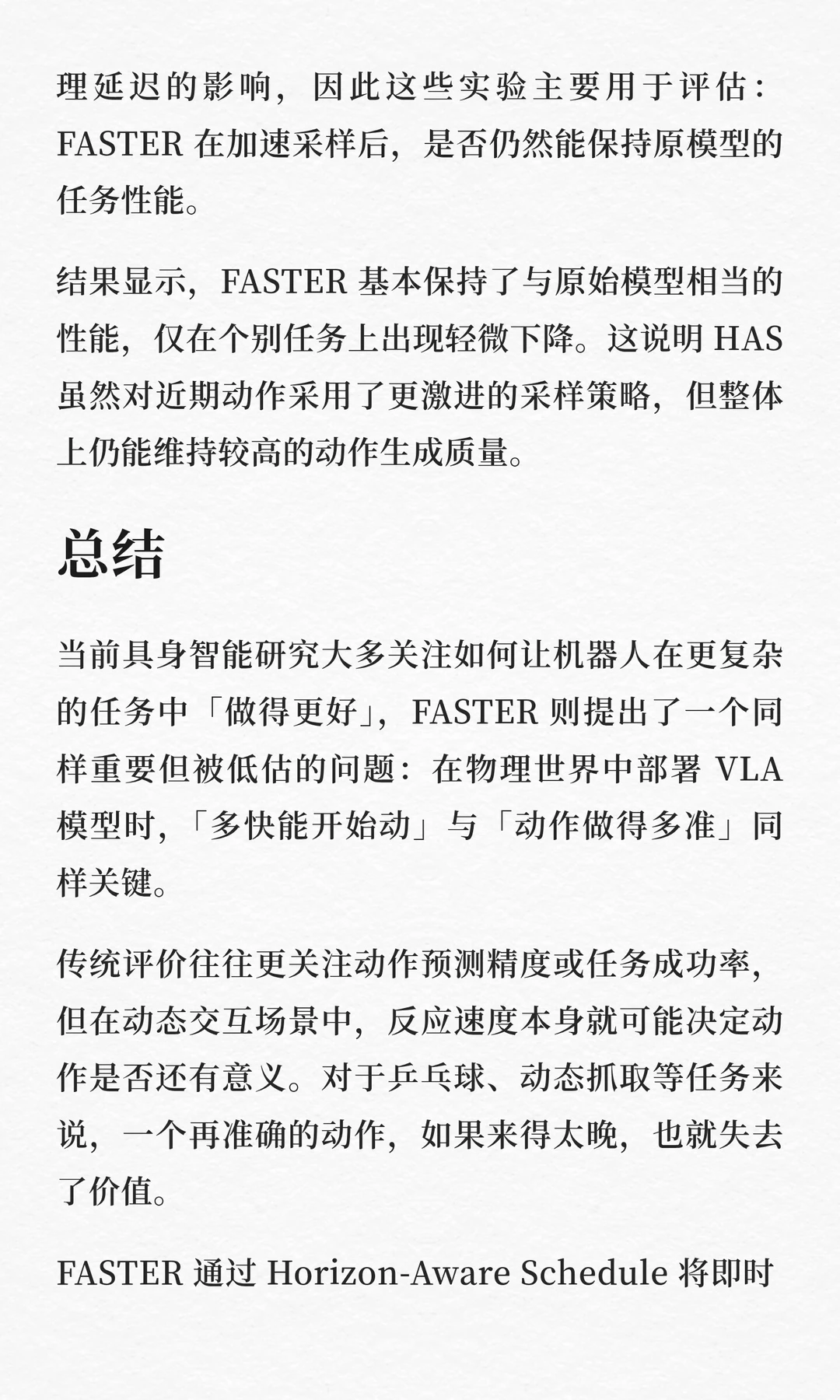

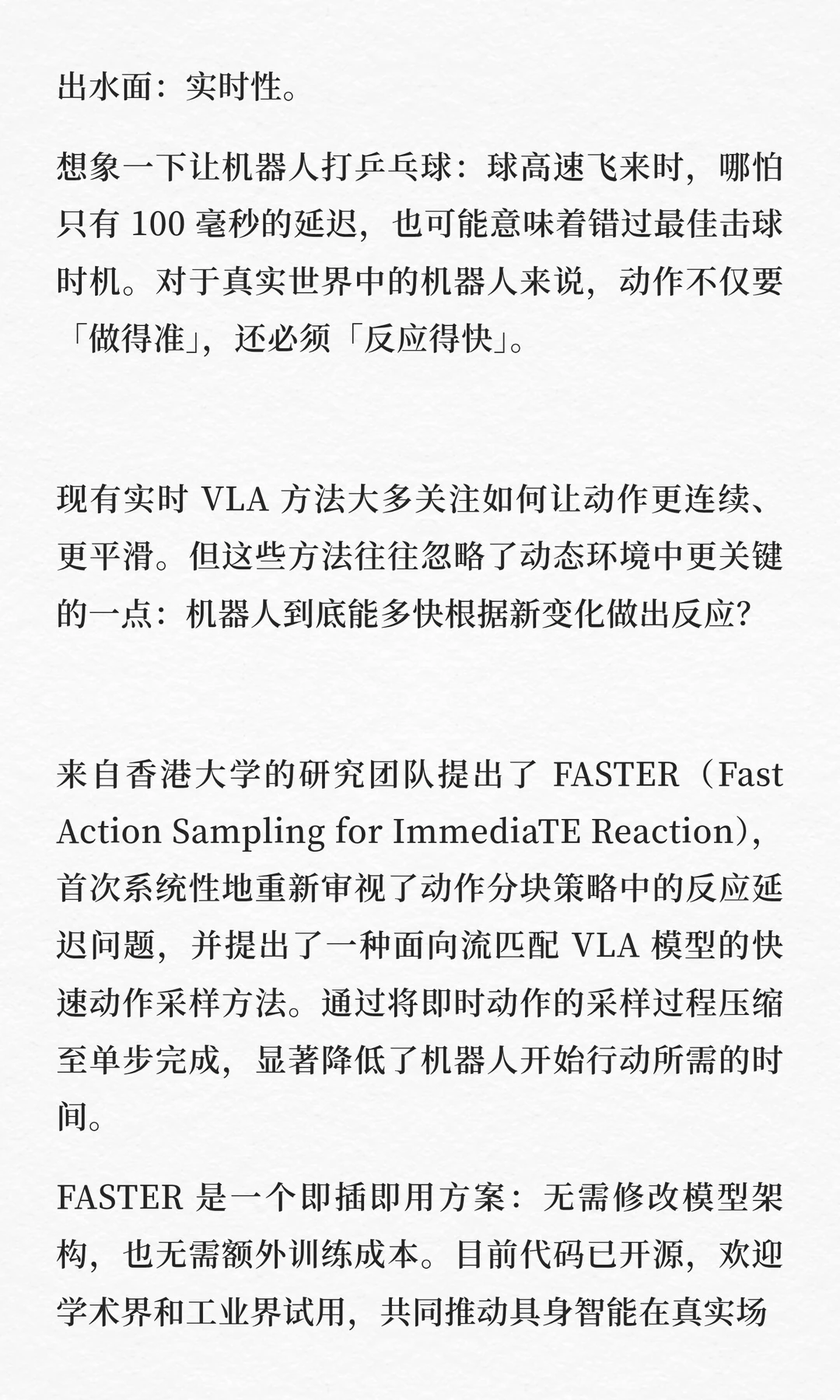

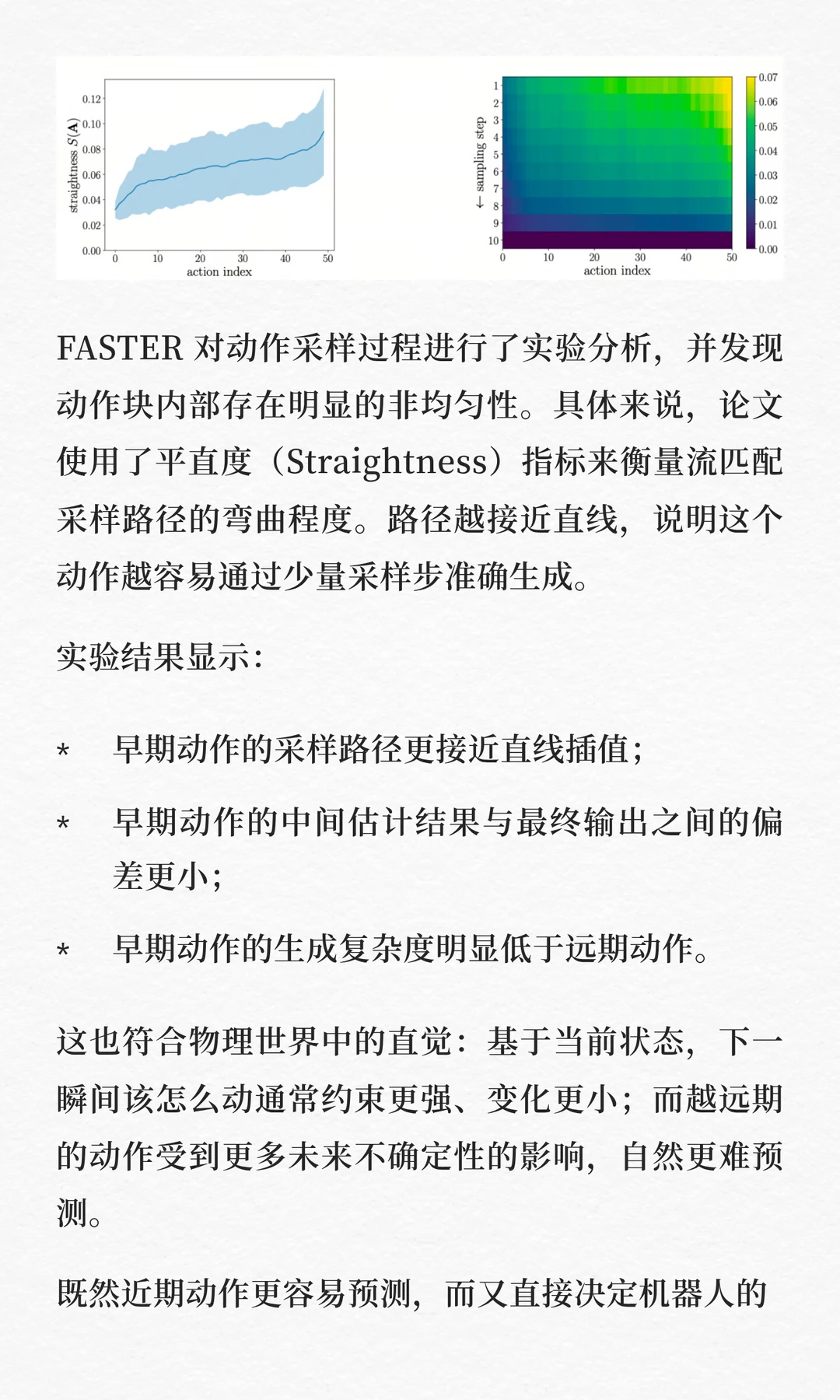

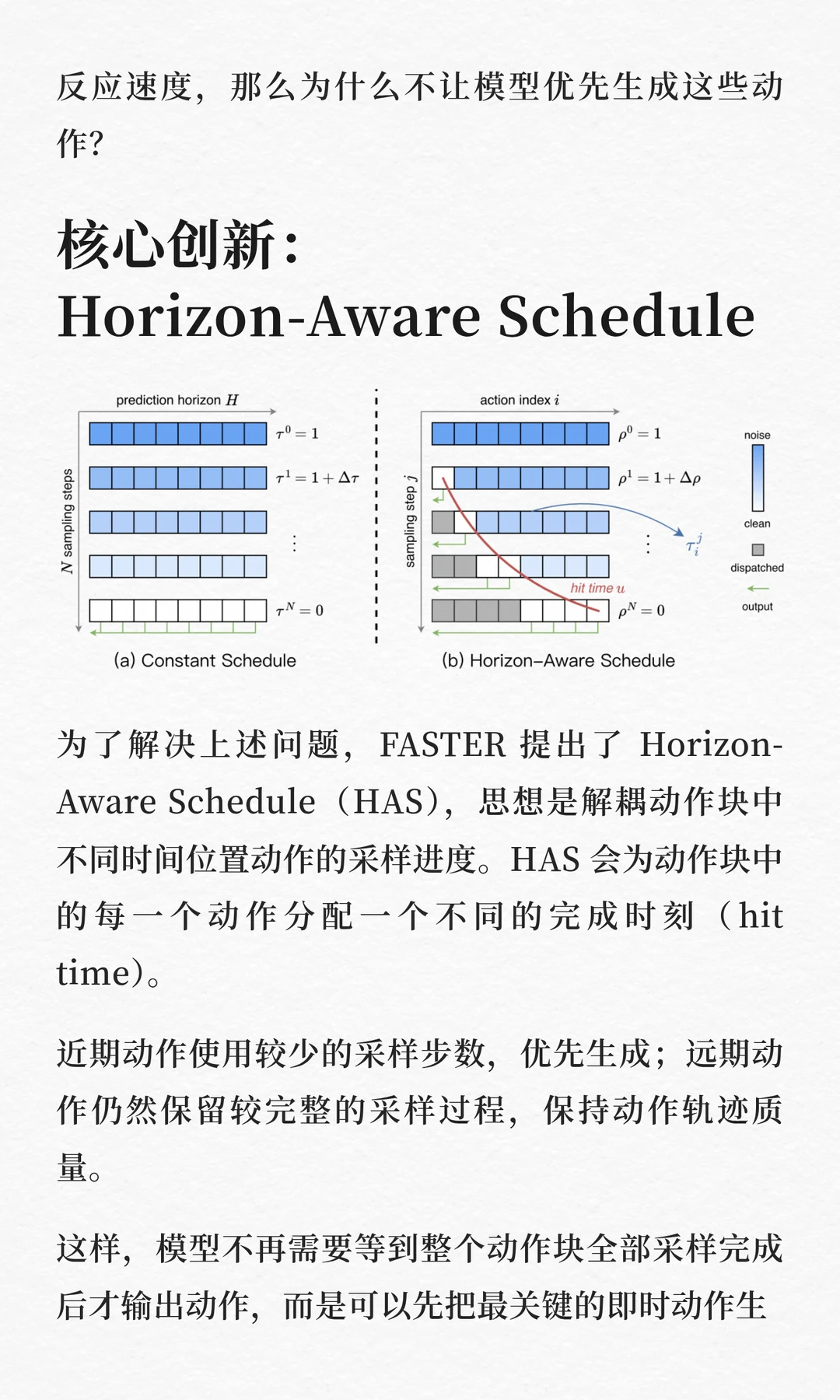

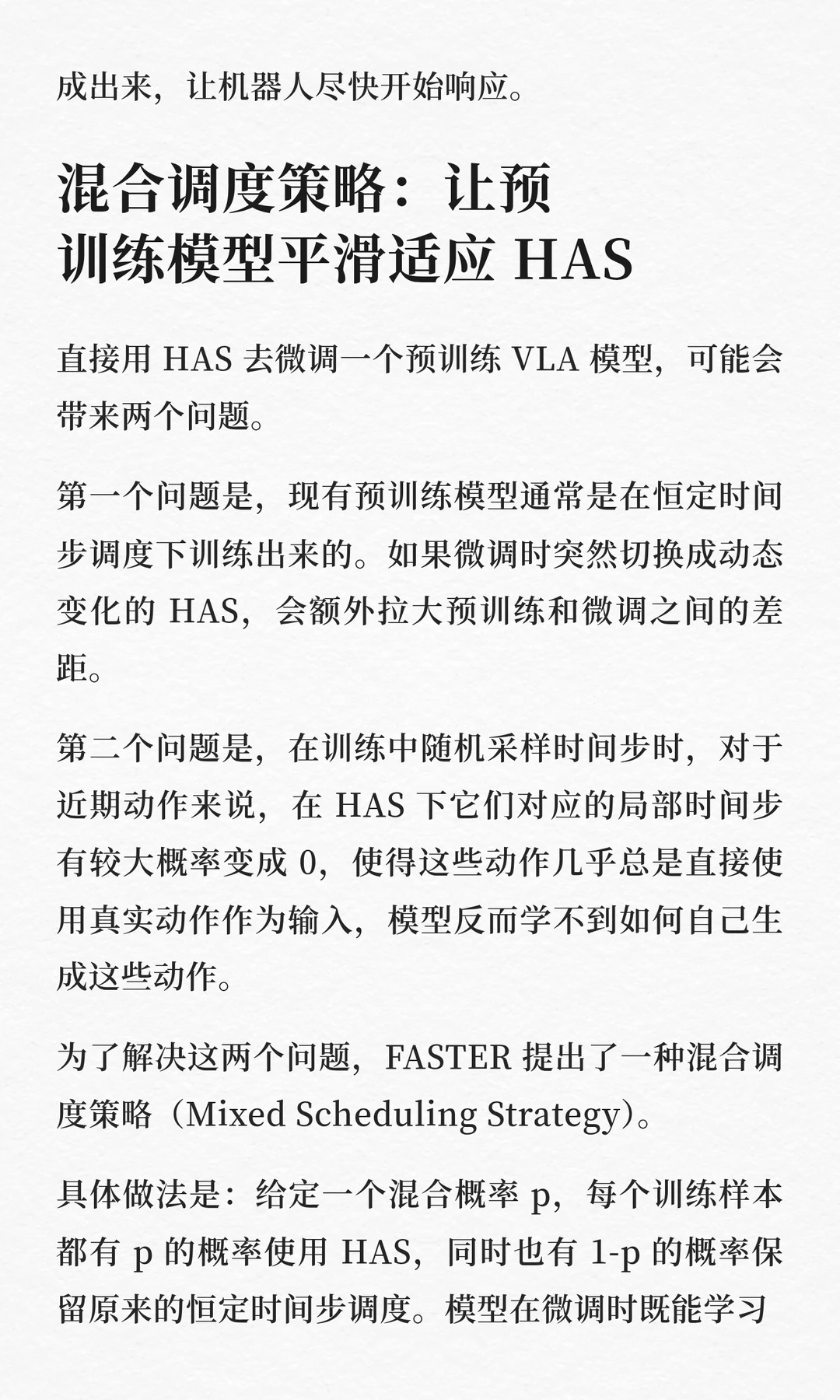

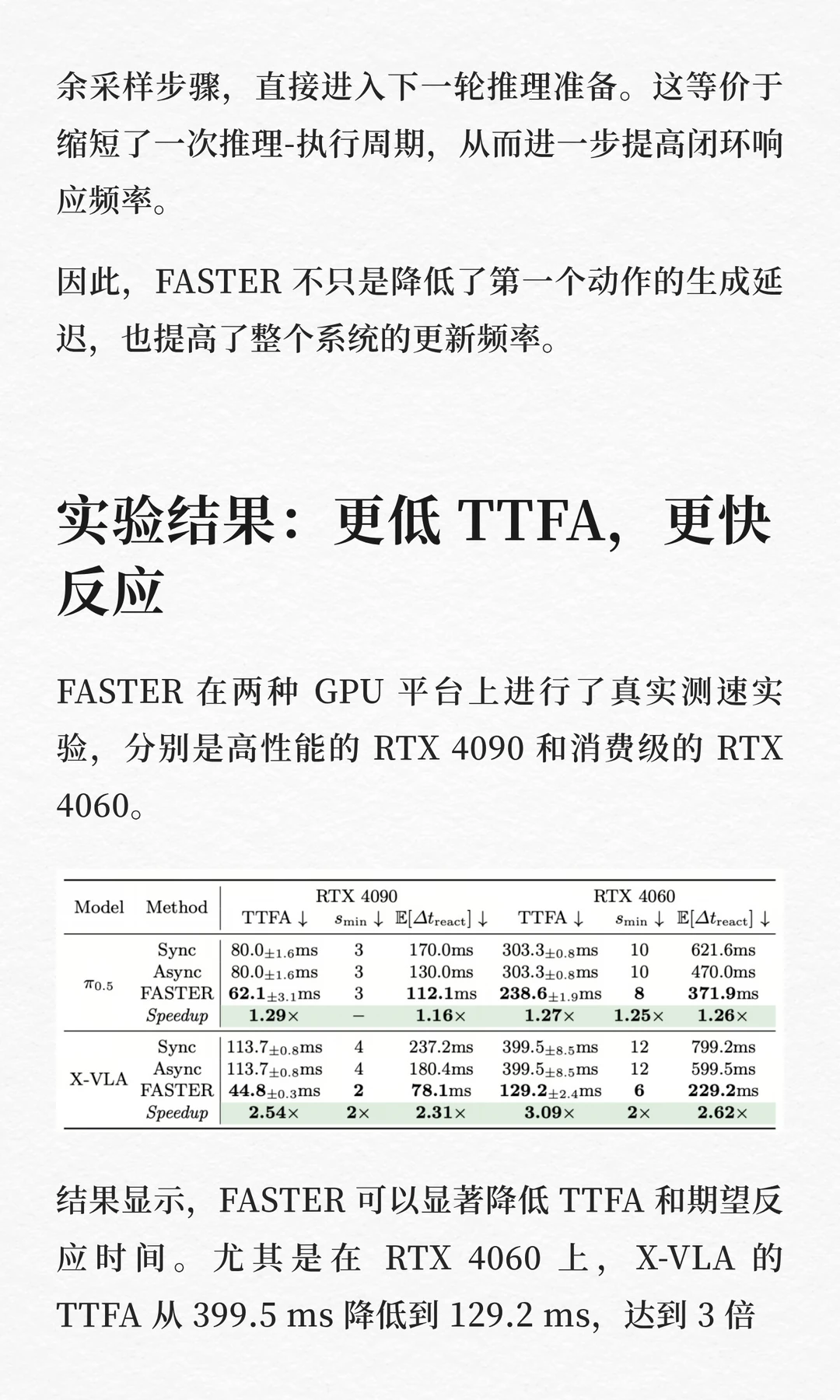

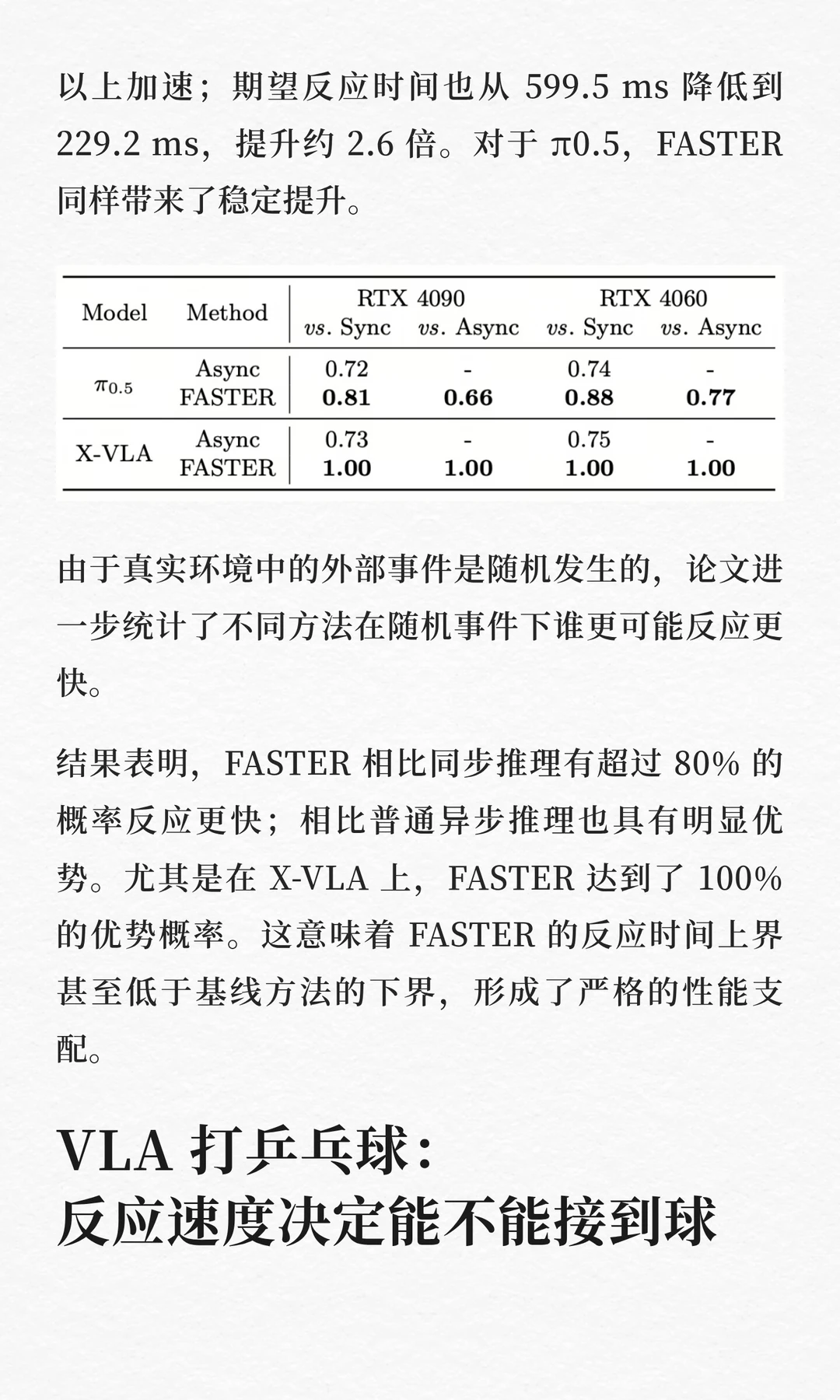

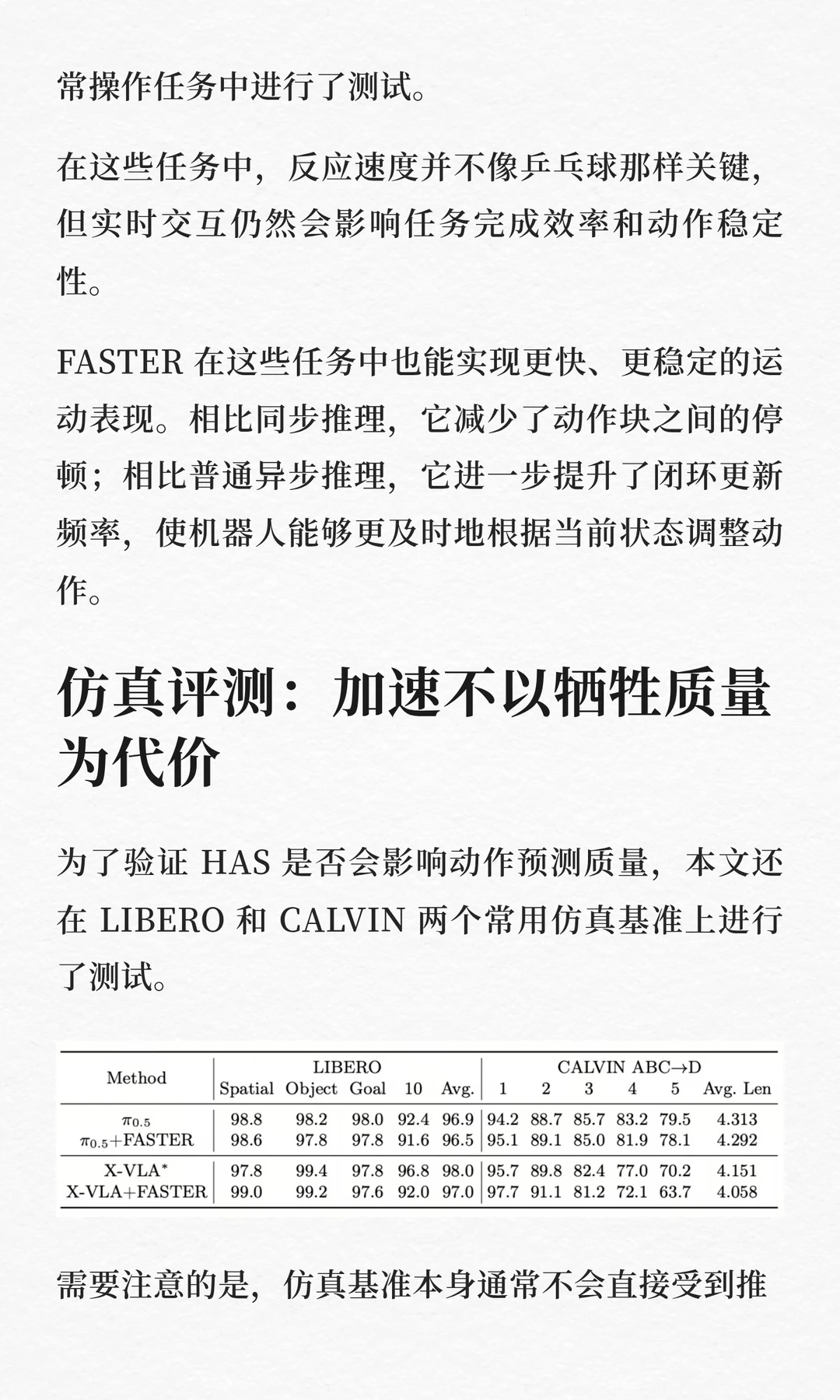

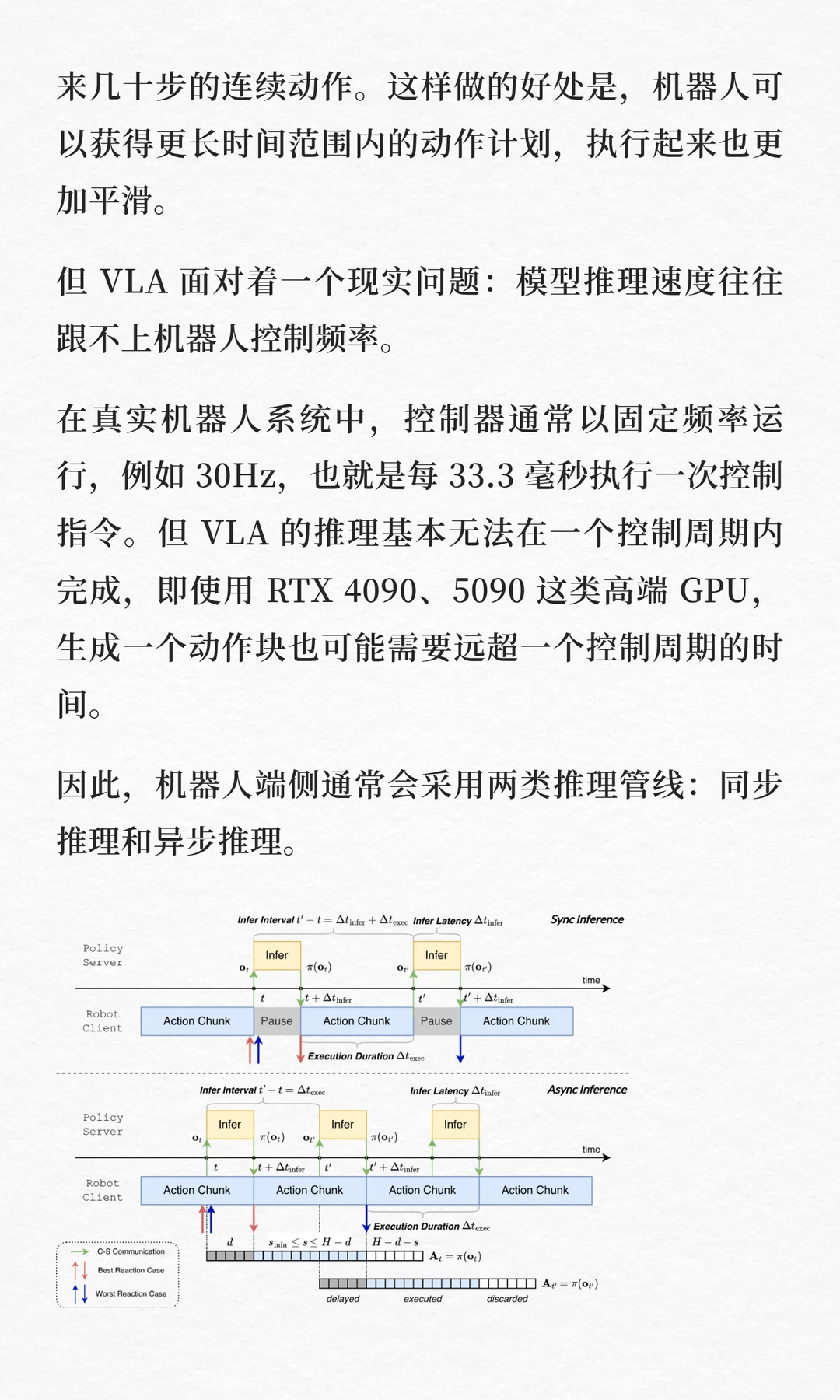

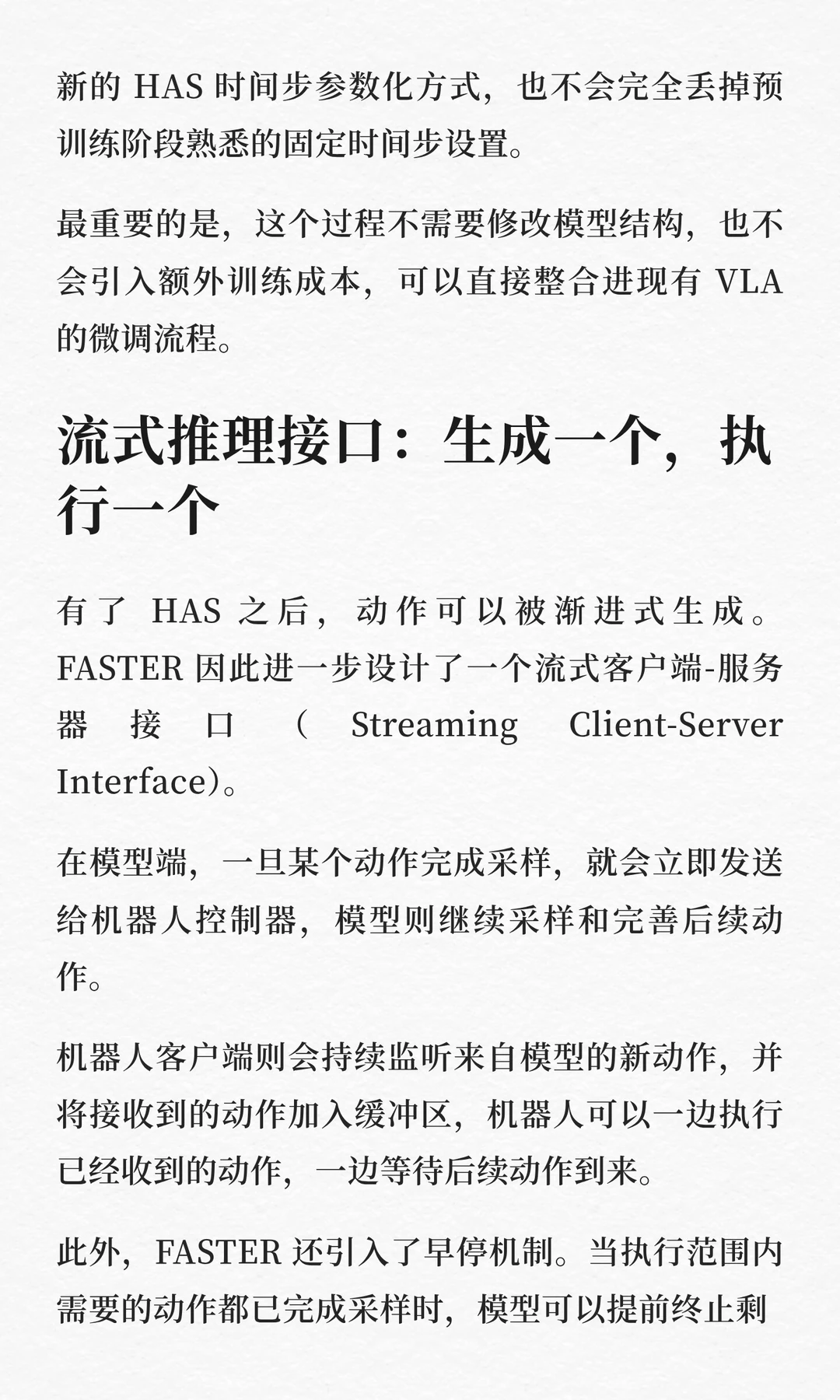

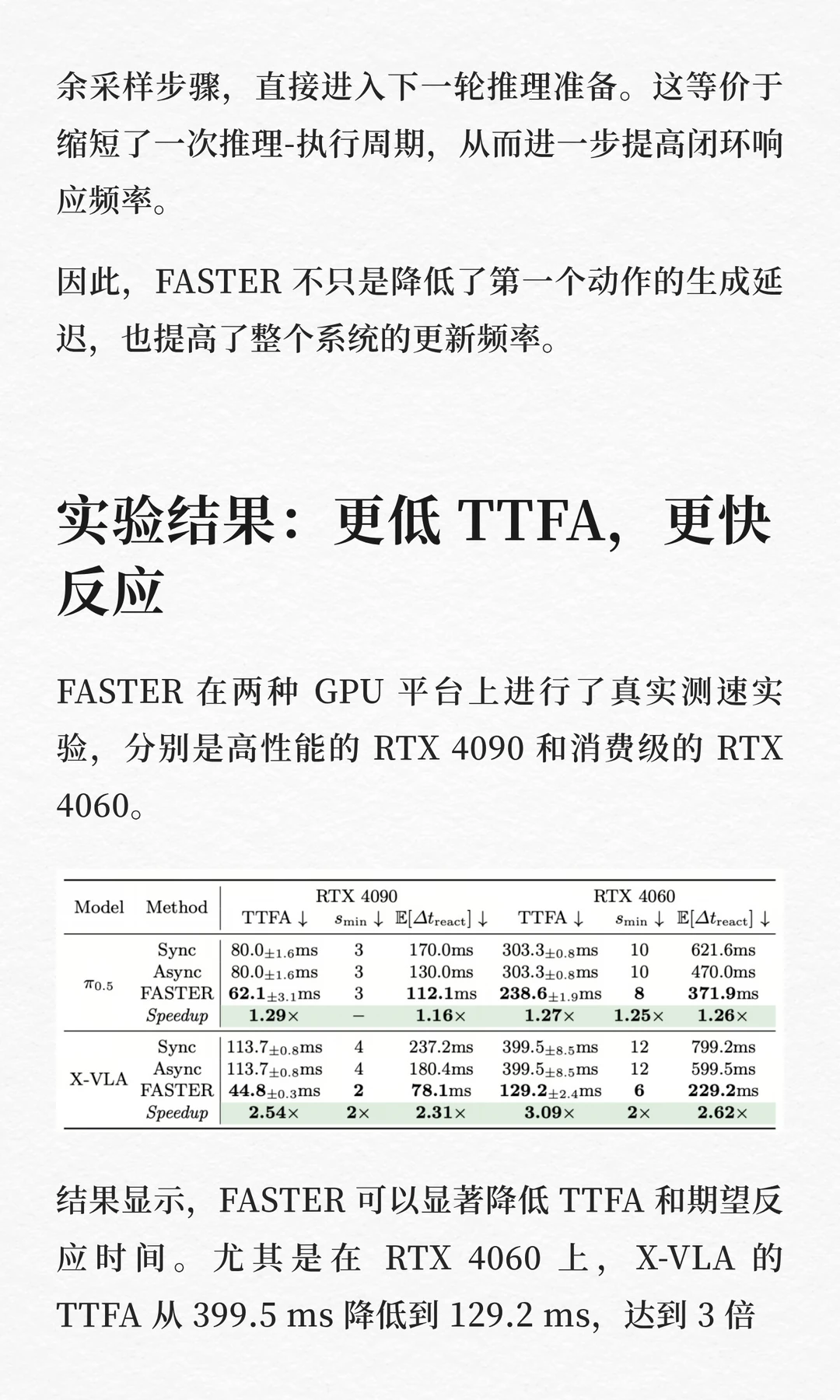

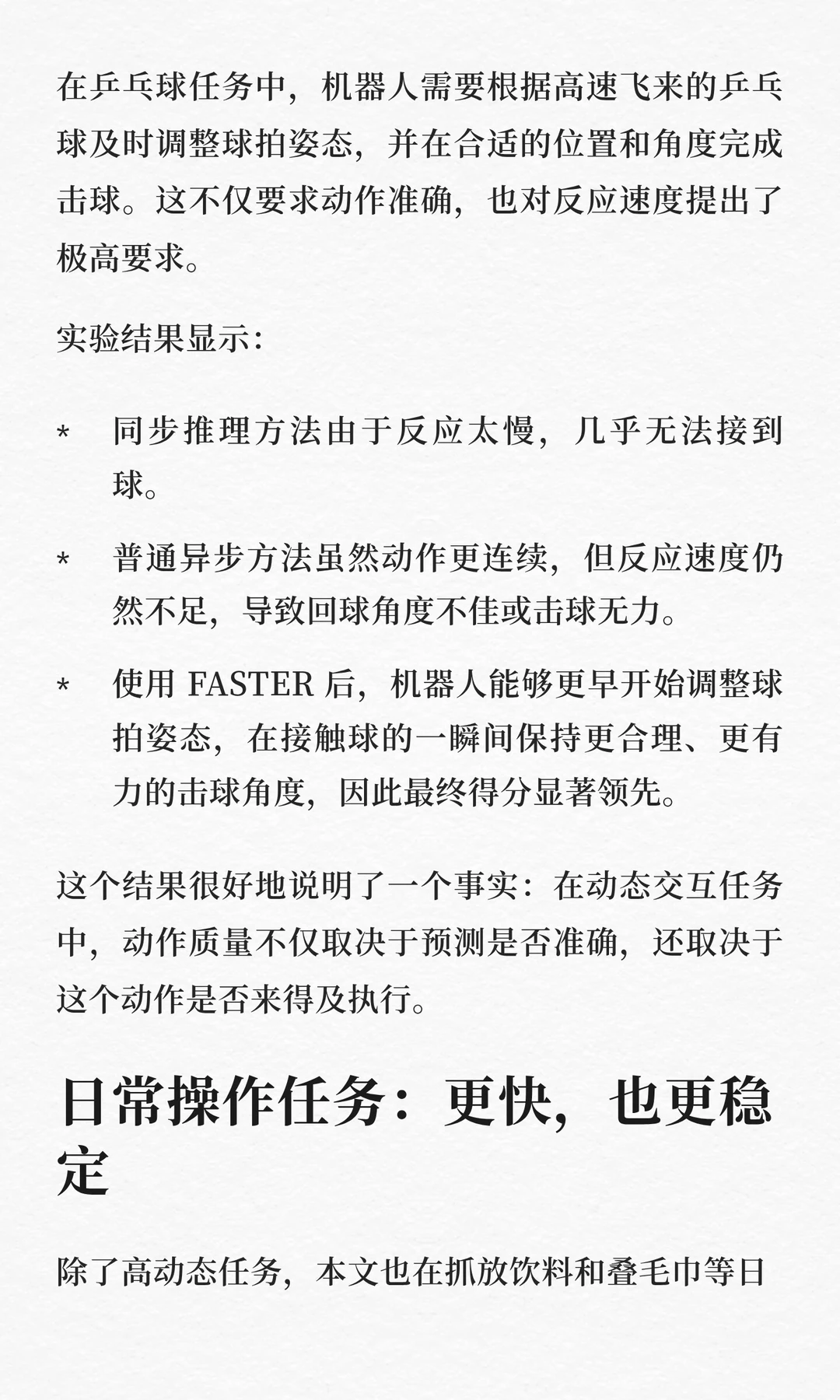

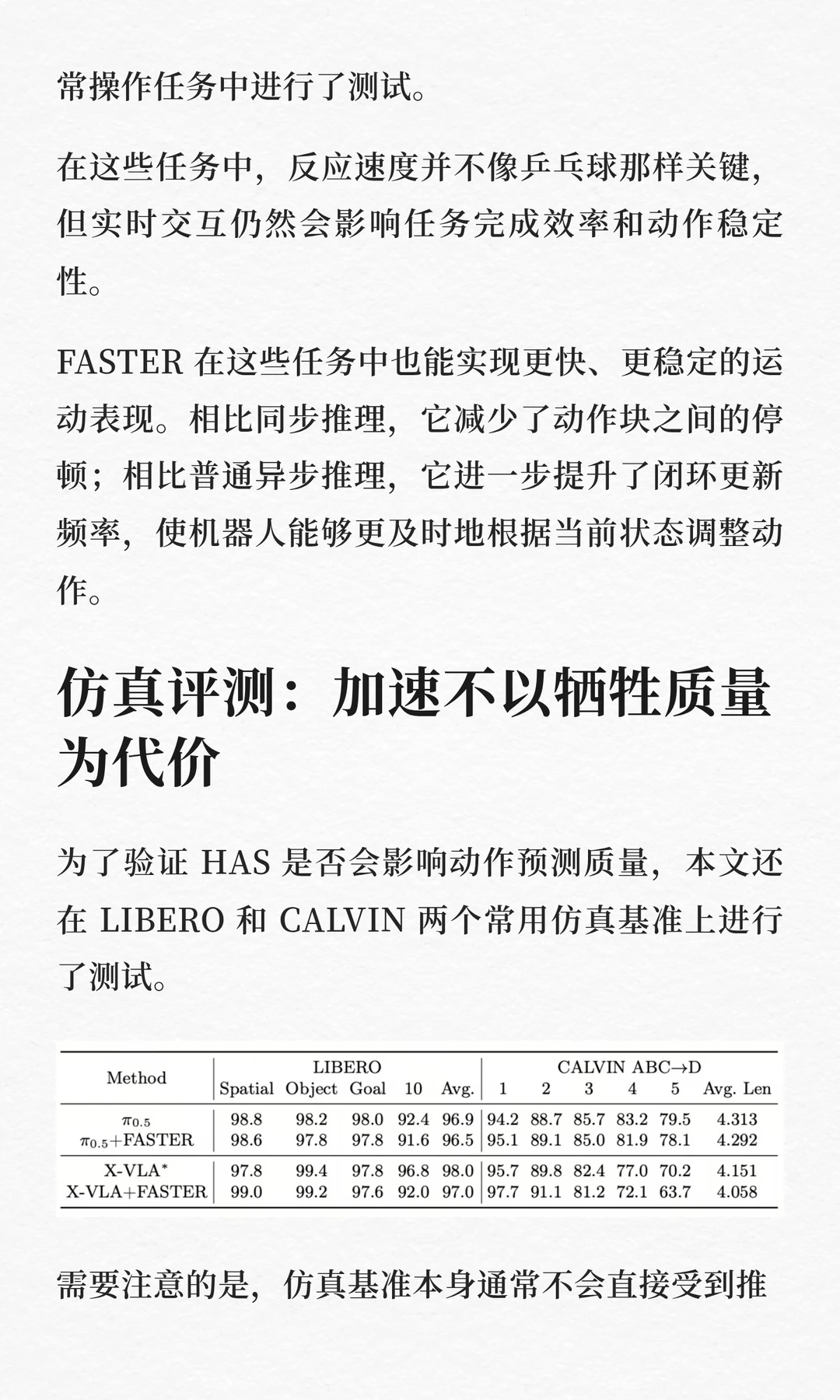

来自香港大学的研究团队提出了 FASTER(Fast Action Sampling for ImmediaTE Reaction),首次系统性地重新审视了动作分块策略中的反应延迟问题,并提出了一种面向流匹配 VLA 模型的快速动作采样方法。通过将即时动作的采样过程压缩至单步完成,显著降低了机器人开始行动所需的时间。

FASTER 是一个即插即用方案:无需修改模型架构,也无需额外训练成本。目前代码已开源,欢迎学术界和工业界试用,共同推动具身智能在真实场景的落地。

完整内容戳👆🏻正文~ 感谢阅读,如果你觉得对你有用的话 ~ 欢迎点赞收藏并分享给你的朋友们~