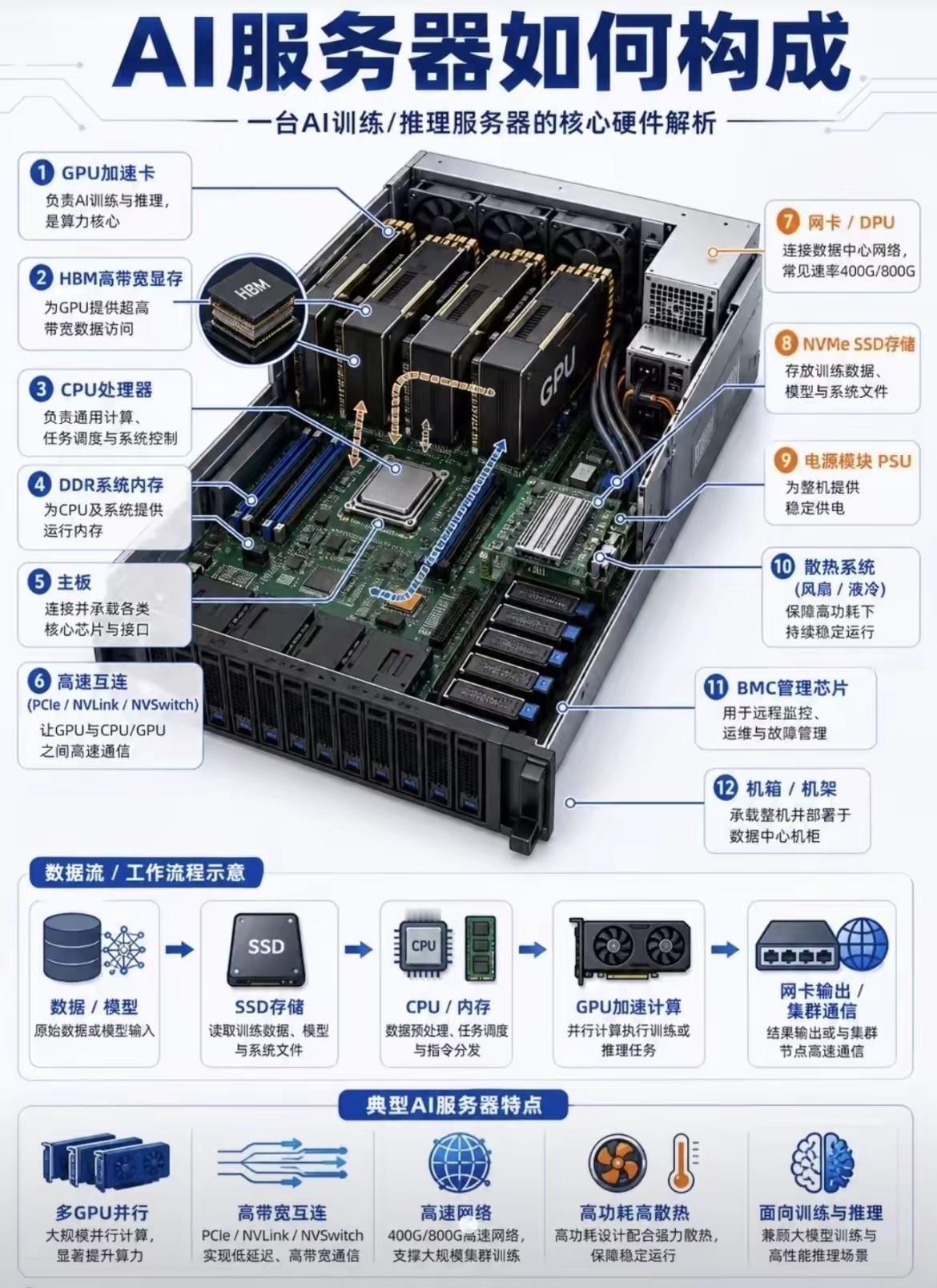

AI服务器硬件构成+全流程精简解析 一、12大核心硬件(按核心优先级) 1. GPU加速卡:AI训练&推理算力核心,整机最昂贵部件 2. HBM高带宽显存:为GPU提供超高带宽数据读写,决定多卡协同效率 3. CPU处理器:通用计算、任务调度、系统控制,统筹整机运行 4. DDR系统内存:CPU与系统运行内存 5. 主板:承载连接所有芯片、接口 6. 高速互联(PCIe/NVLink):GPU之间高速通信,保障并行算力 7. 网卡/DPU:连接数据中心网络,支持400G/800G高速传输 8. NVMe SSD存储:存放训练数据、大模型文件、系统文件 9. 电源模块:整机稳定供电,适配高功耗 10. 散热系统:风扇/液冷,解决高功耗散热问题 11. BMC管理芯片:远程监控、运维、故障管理 12. 机箱/机架:整机部署载体 二、标准数据流工作流程 原始数据/模型 → SSD存储读取 → CPU预处理调度 → GPU并行计算 → 网卡输出/集群通信 三、AI服务器典型特点 - 多GPU并行:大规模并行计算,提升算力 - 高带宽互联:低延迟、高速多卡通信 - 高速网络:400G/800G网卡,支撑集群训练 - 高功耗强散热:适配AI高负载持续运行 - 全场景适配:兼顾大模型训练与高性能推理 AI开发流程 企业级AI架构 AI计算架构 AI系统架构 AI底层架构 AI架构调整 ai部署教程