[CL]《Continuous Latent Diffusion Language Model》H Guo, Q Zhao, Y Zhao, S Nie… [Bytedance Seed] (2026)

在语言生成中,固定从左到右写作是悬而未决的难题。过去的自回归模型受困于逐词顺序,本质原因是语义规划与表层措辞被绑在同一条链上。

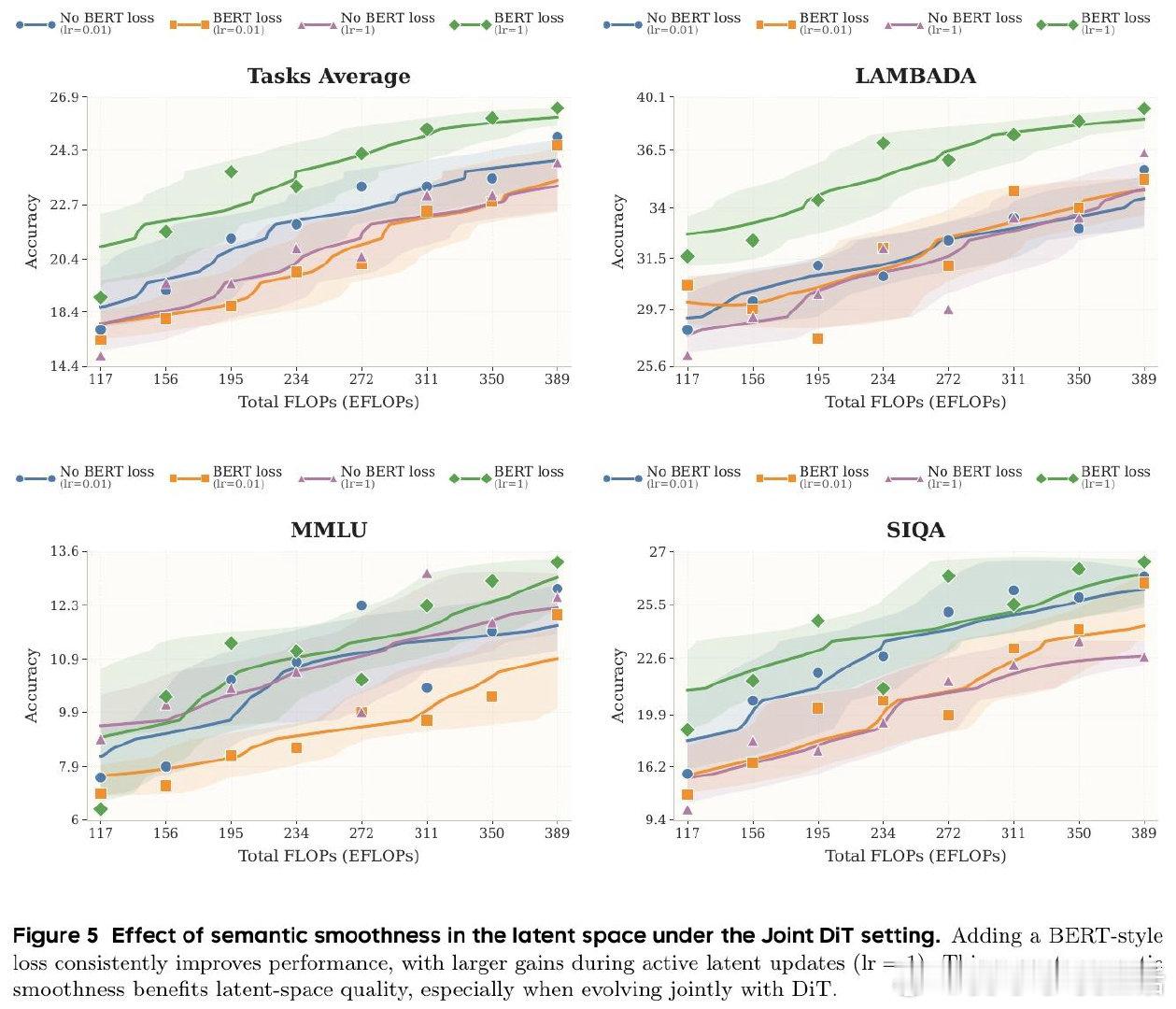

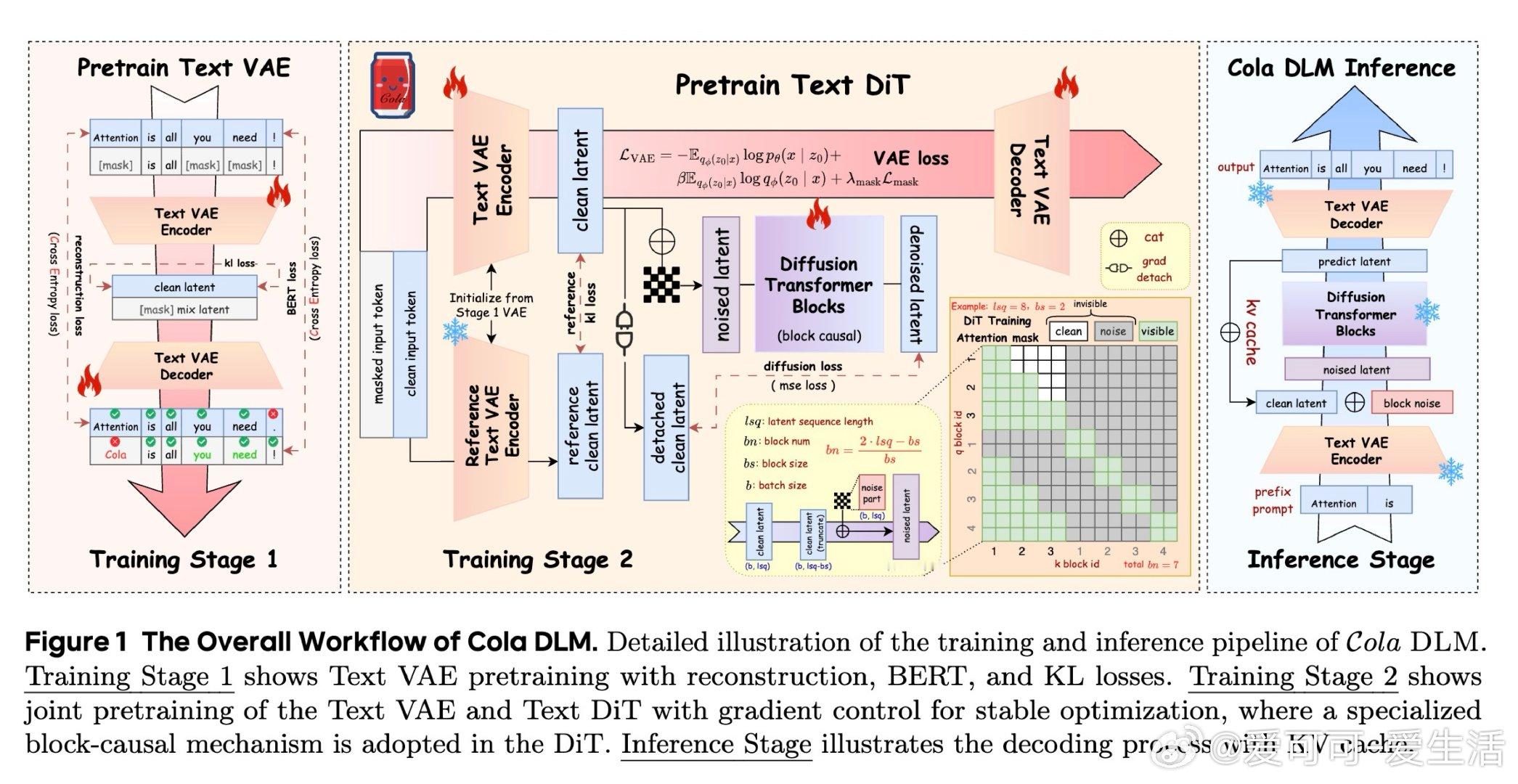

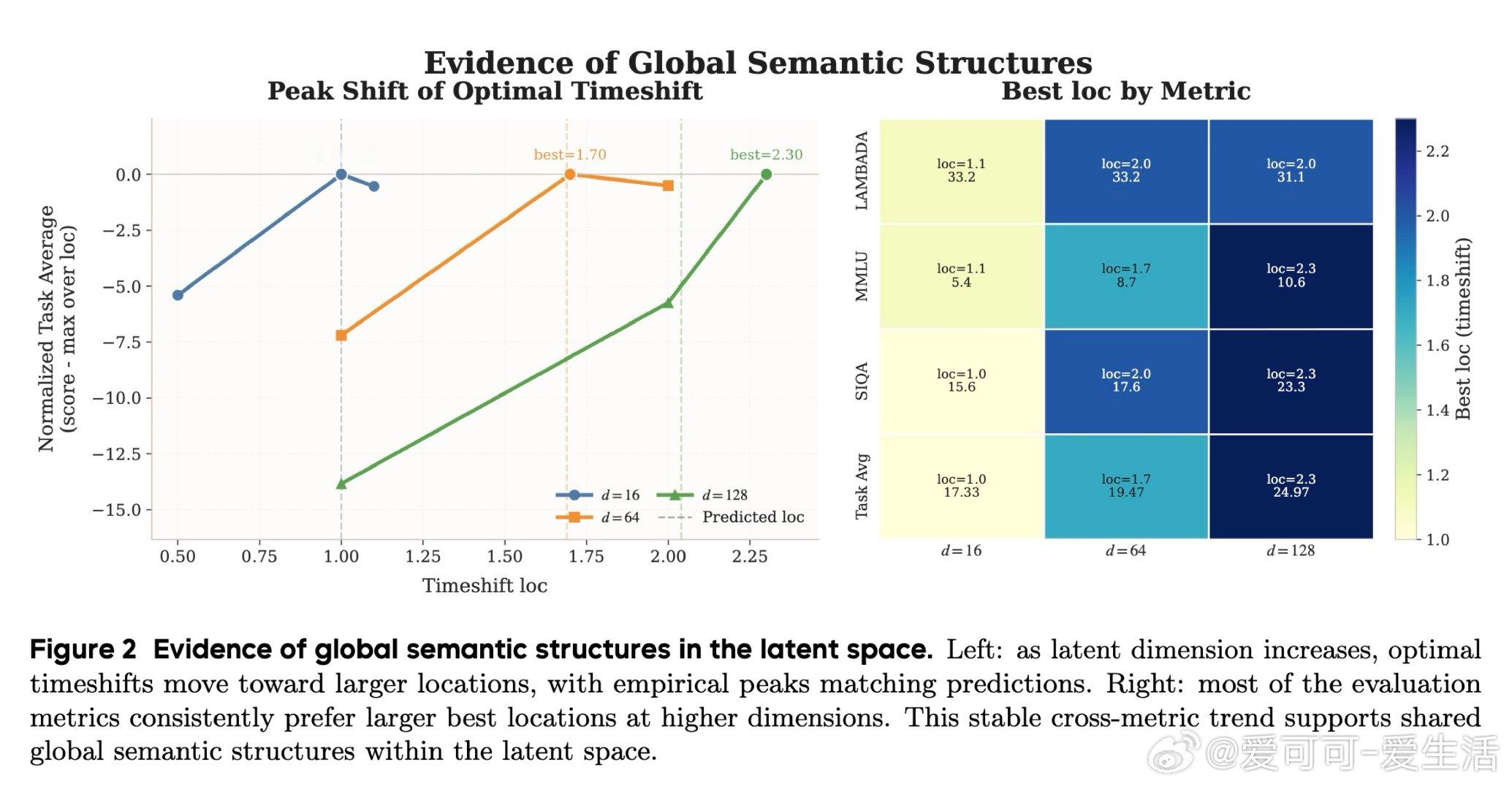

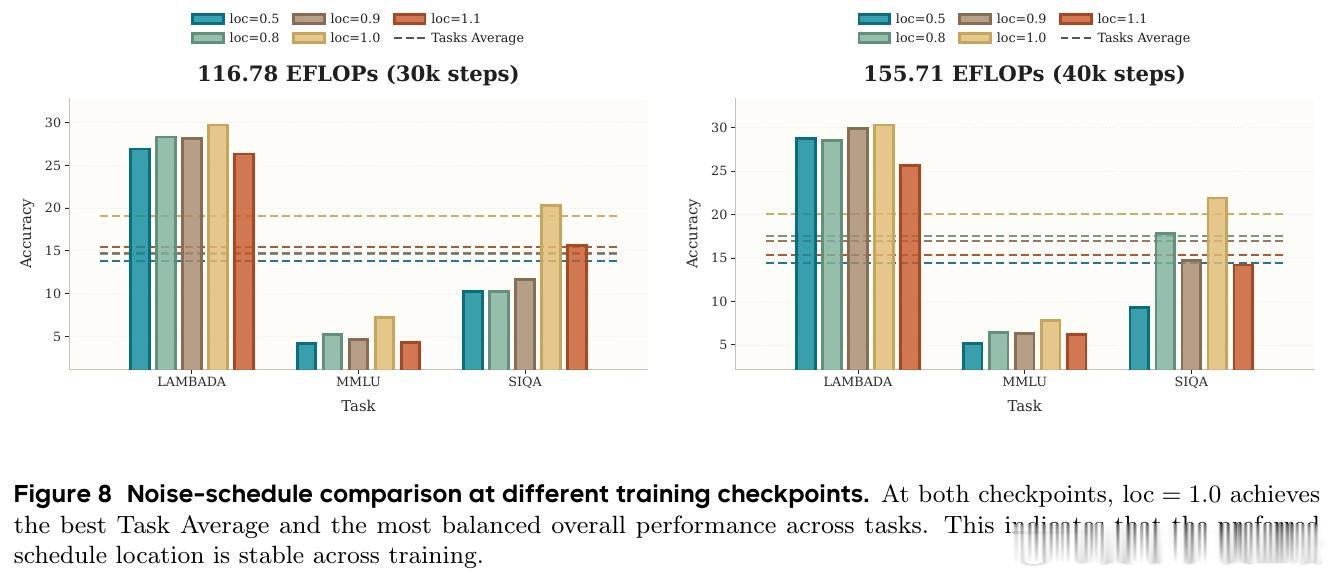

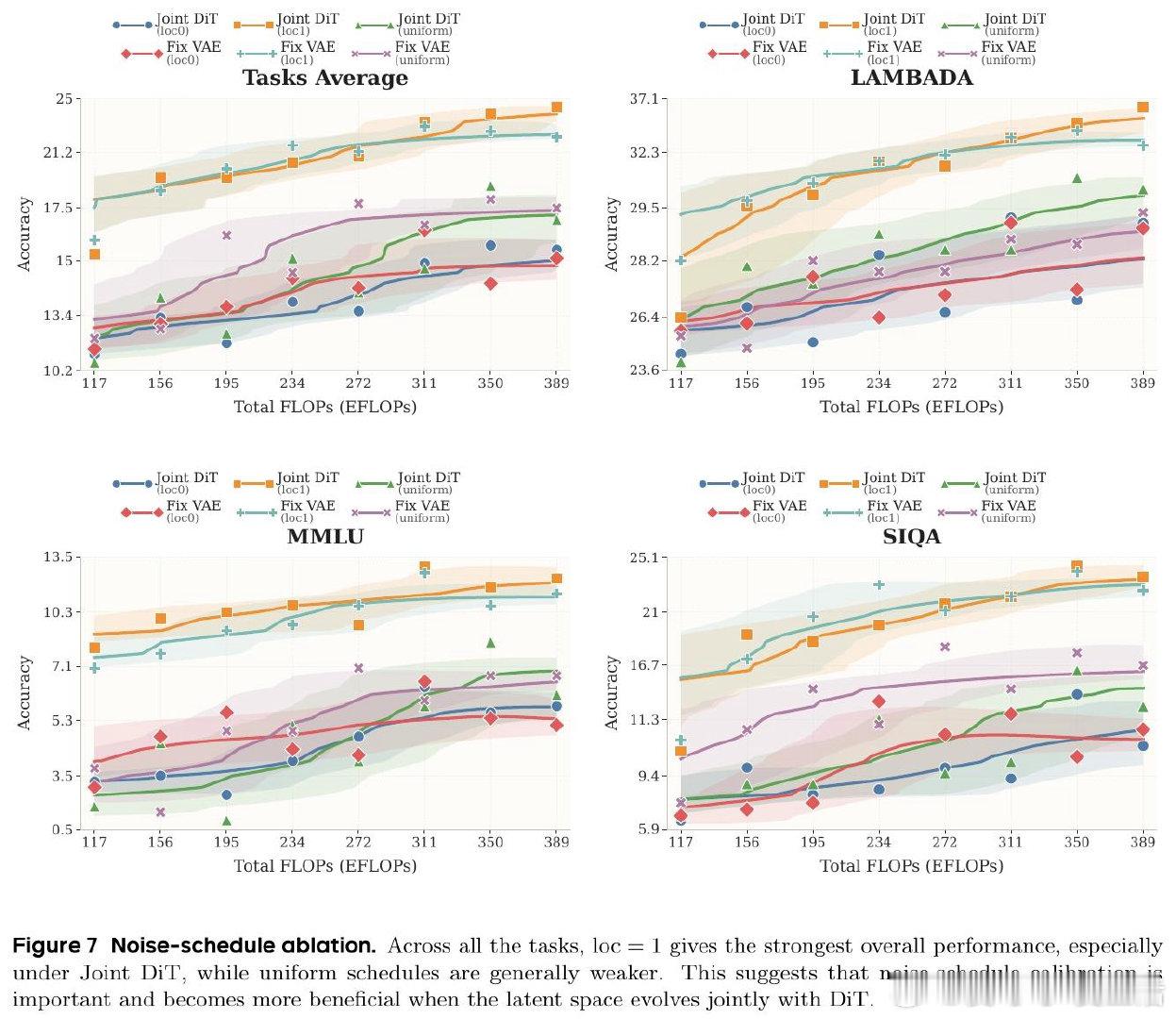

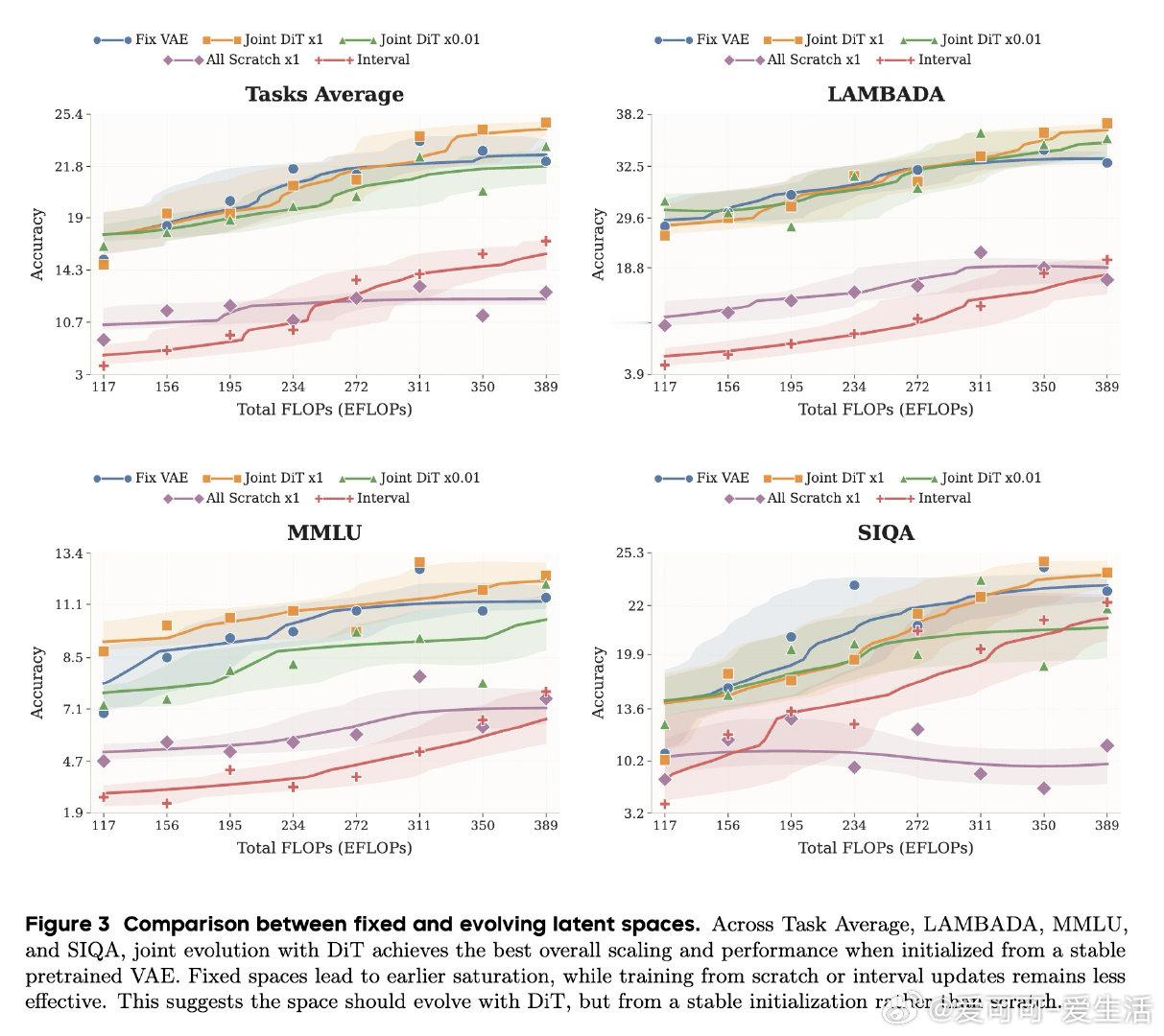

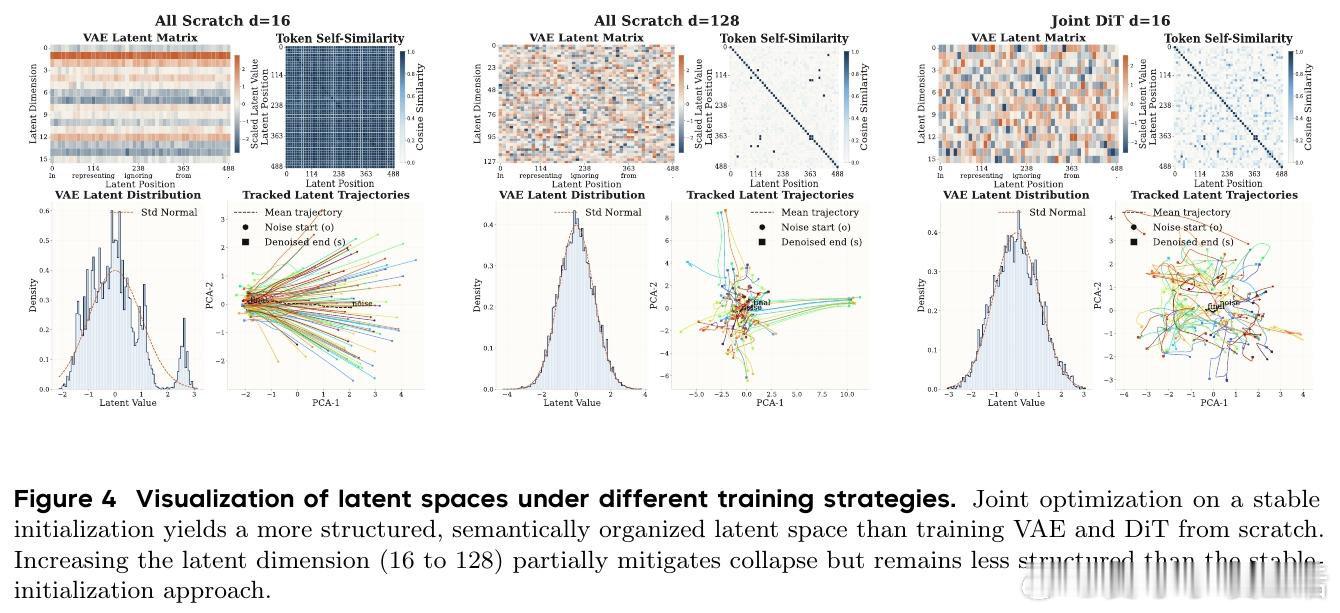

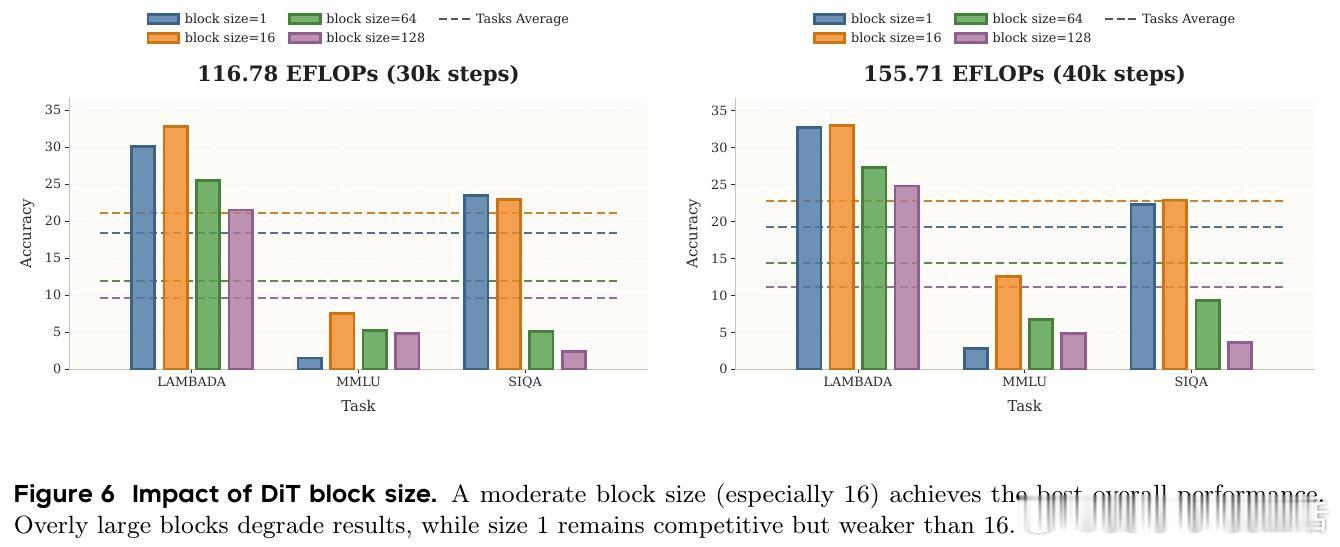

本文的核心洞见是:把文本生成重新看作“先形成语义潜变量,再落成词句”。由此,VAE压缩文本、DiT扩散建模潜在语义、解码器成文,使顺序束缚得以松开。

这项工作真正留下的遗产是把扩散从词元修复转向语义先验运输。它打开了文本与连续模态统一生成的新门,但尚未跨过似然失配、潜变量压缩与推理调参的门槛。

arxiv.org/abs/2605.06548 机器学习 人工智能 论文 AI创造营