Hugging Face 团队的重磅电子书来啦:《Smol 训练手册:打造世界一流大语言模型的秘密》huggingface.co/spaces/HuggingFaceTB/smol-training-playbook这里记录了Hugging Face 团队复盘他们训练 SmolLM3 的全过程:为什么要训练、怎么做取舍、遇到哪些现实问题,以及如何把一个基础模型打磨成真正可用的产品级模型。

"如今,训练一个高性能大语言模型到底需要什么?

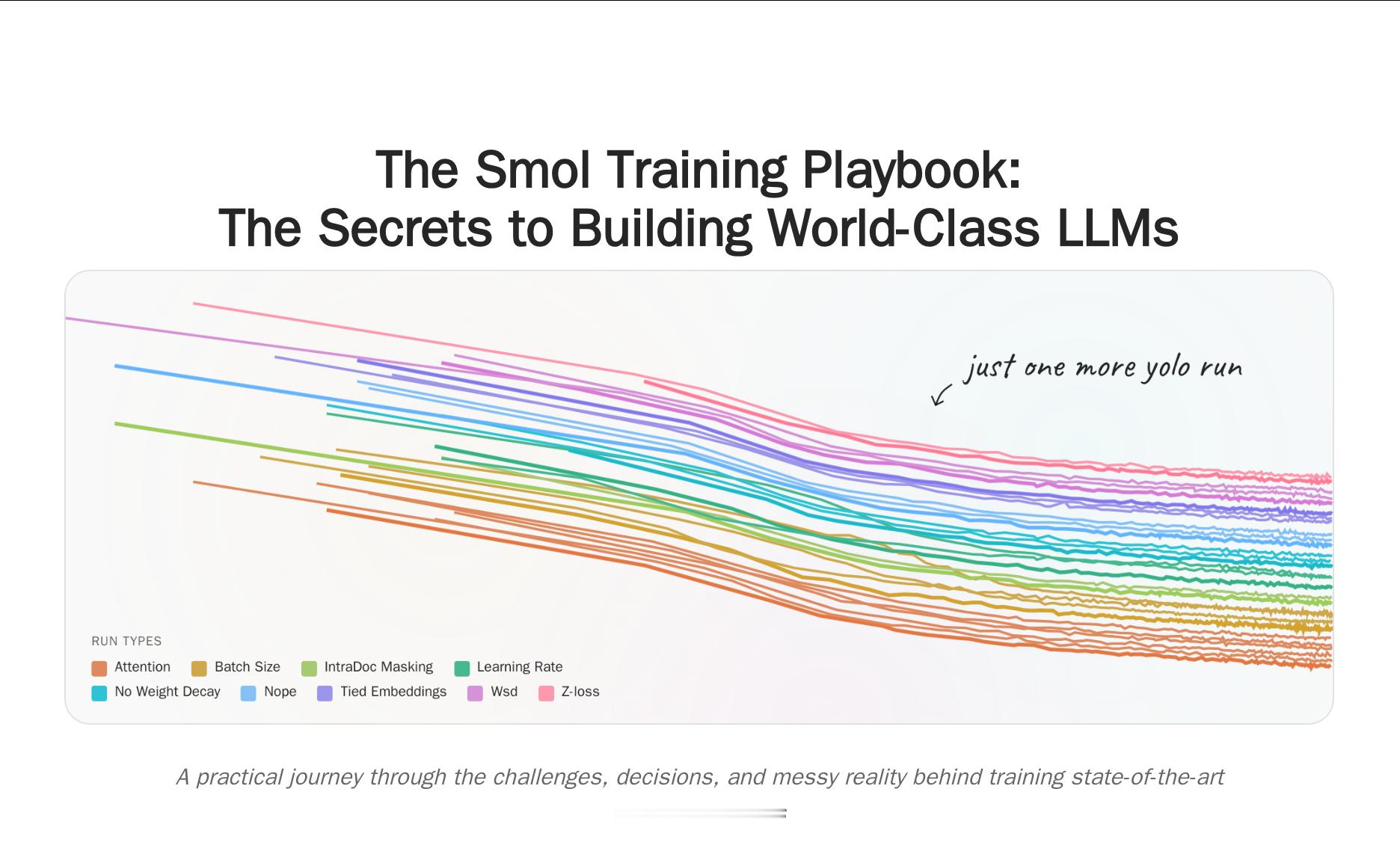

公开发表的研究常常让这件事看起来很直接:做出有策略的架构选择,精心整理数据集,再配上足够的算力。结果看起来很完善,消融实验也结构清晰、干净利落。事后回看,每一个决定似乎都显而易见。但这些报告通常只展示了成功的部分,并带有一点“事后美化”的色彩。它们并不会记录凌晨两点调试数据加载器的过程、突然飙升的损失值,或是那个悄悄破坏训练效果的微妙张量并行 bug(后文会讲到!)。现实要混乱得多,也更依赖反复迭代,充满了许多最终不会写进论文里的决策。

接下来,我们将带你走进 SmolLM3 训练的幕后。SmolLM3 是一个拥有 30 亿参数、支持多语言推理的模型,训练数据量达到 11 万亿 tokens。这不是一份普通的指南,而是一次对复杂决策网络的梳理:那些决策、发现和死胡同最终让我们深入理解了,打造世界级语言模型到底需要什么。

这也是我们长篇模型训练系列的最终篇章。此前,我们已经探讨过如何大规模构建数据集(FineWeb),如何协调数千张 GPU 像合唱团一样协同工作(The Ultra-Scale Playbook),以及如何在流程的每一步选择最合适的评估方法(The LLM Evaluation Guidebook)。现在,我们要把这一切整合起来,构建一个强大的 AI 模型。我们会带你走完整个过程——不只是最终奏效的配方,还包括失败、基础设施故障,以及影响每一个决策的调试过程。你会看到,为什么一些在小规模消融实验中看起来很有前景的结果,放大到大规模训练时却未必成立;为什么我们在训练了 1 万亿 tokens 之后选择重新开始;我们如何在多语言、数学和代码能力这些相互竞争的目标之间取得平衡,同时保持强大的英语表现;以及最后,我们如何对一个混合推理模型进行后训练。

我们尽量避免只是罗列我们做过的所有事情,而是希望以一个有条理的故事来讲述这段探索经历。你可以把它看作一份指南,写给那些想从“我们有很棒的数据集和 GPU”走到“我们真的训练出了一个很强模型”的人。我们希望这种开放分享能帮助弥合研究与生产之间的差距,也让你的下一次训练少一点混乱。"

AI创造营How I AI