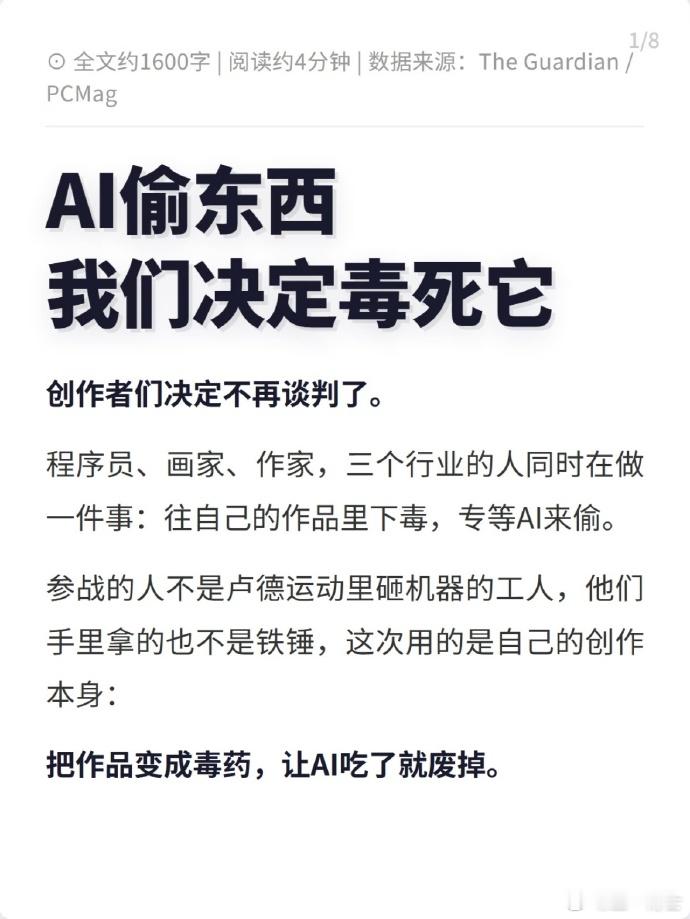

AI在偷我们的东西 我们决定毒死它

Nightshade这个工具,下载量超过250万次了。

原理很简单:给图片加一层像素级的扰动,人眼完全看不出来,但AI模型吃进去之后,会把狗认成猫,把车认成牛。250张处理过的图,就够污染一个几十亿参数的大模型。用开发者单思雄的话说,这不是破坏,是让偷数据的公司付出代价。

艺术家为什么用这个东西?因为法律跟不上。他们发现自己的画被拿去训练商用模型,没授权,没付费,连招呼都不打。起诉有用吗?有,但太慢。纽约南区法院驳回了OpenAI的驳回动议,《纽约时报》的案子要进入实质审理了;英国那边,Getty Images诉Stability AI也在打。但另一边,法院又认定Meta训练LLaMA的某些环节算合理使用。判例来回拉锯,创作者等不起。

所以Nightshade是个谈判筹码。芝加哥大学团队还做了另一个工具Glaze,850万次下载,专门防止AI学走画风。一个防,一个攻,创作者自己搭了一套防御系统。

AI公司说这叫阻碍创新。逻辑是:你们不许妨碍我们免费拿走东西。单思雄回了一句——“如果创新要牺牲别人的饭碗,那当然可以阻挡。”

版权边界目前是模糊的。在法院画清楚之前,技术手段会一直存在。哪天你看到AI画出一只六条腿的猫,不用奇怪,那可能是一张被下了药的图终于进了训练池~