学习强化学习常常需要翻阅各种资料,经典教材讲基础理论,前沿论文聊大模型对齐,代码实现又分散在不同仓库,理解起来颇为费力。

Hands-on Modern RL 把强化学习从入门到前沿全部整合,提供一套完整的实战学习路线。

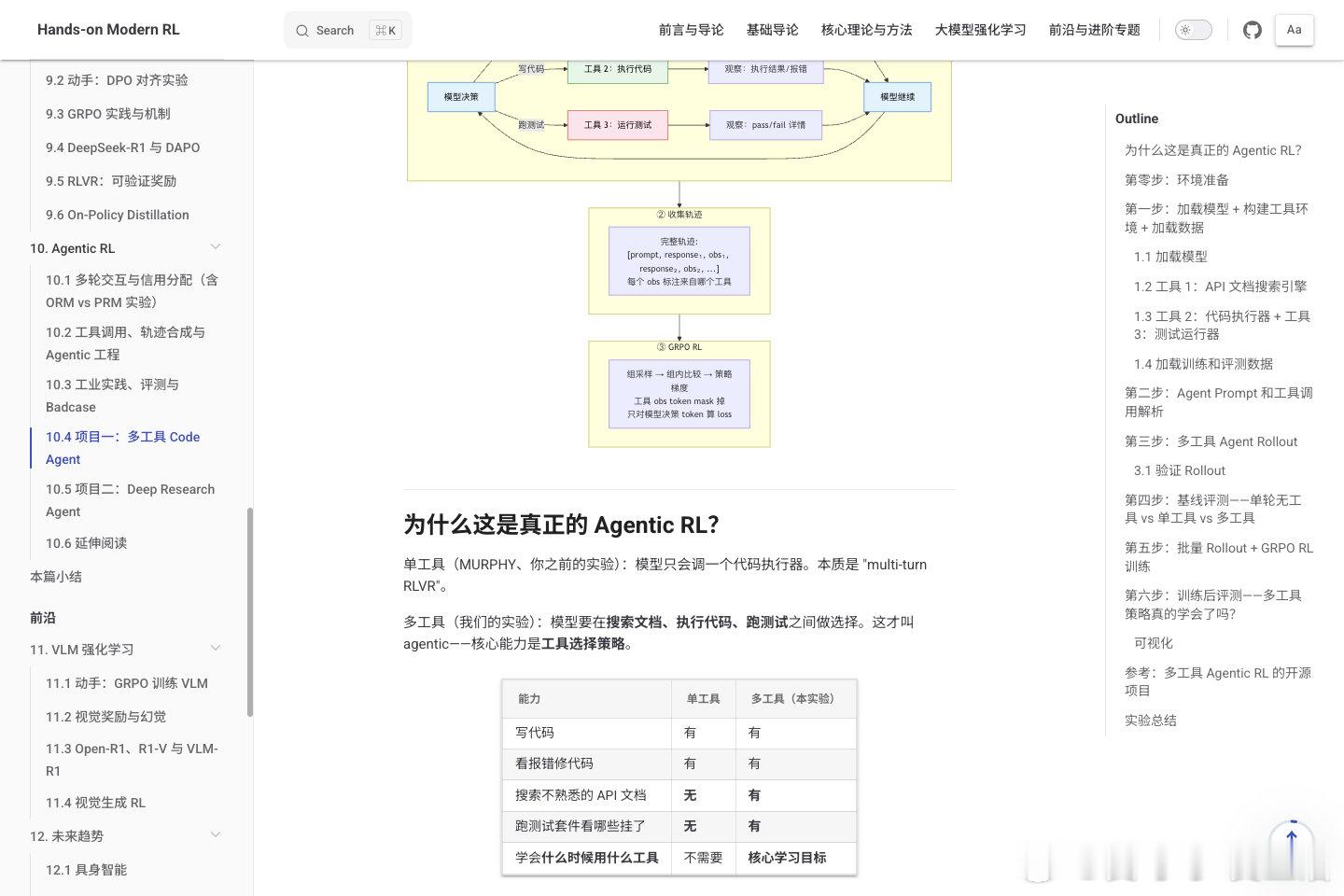

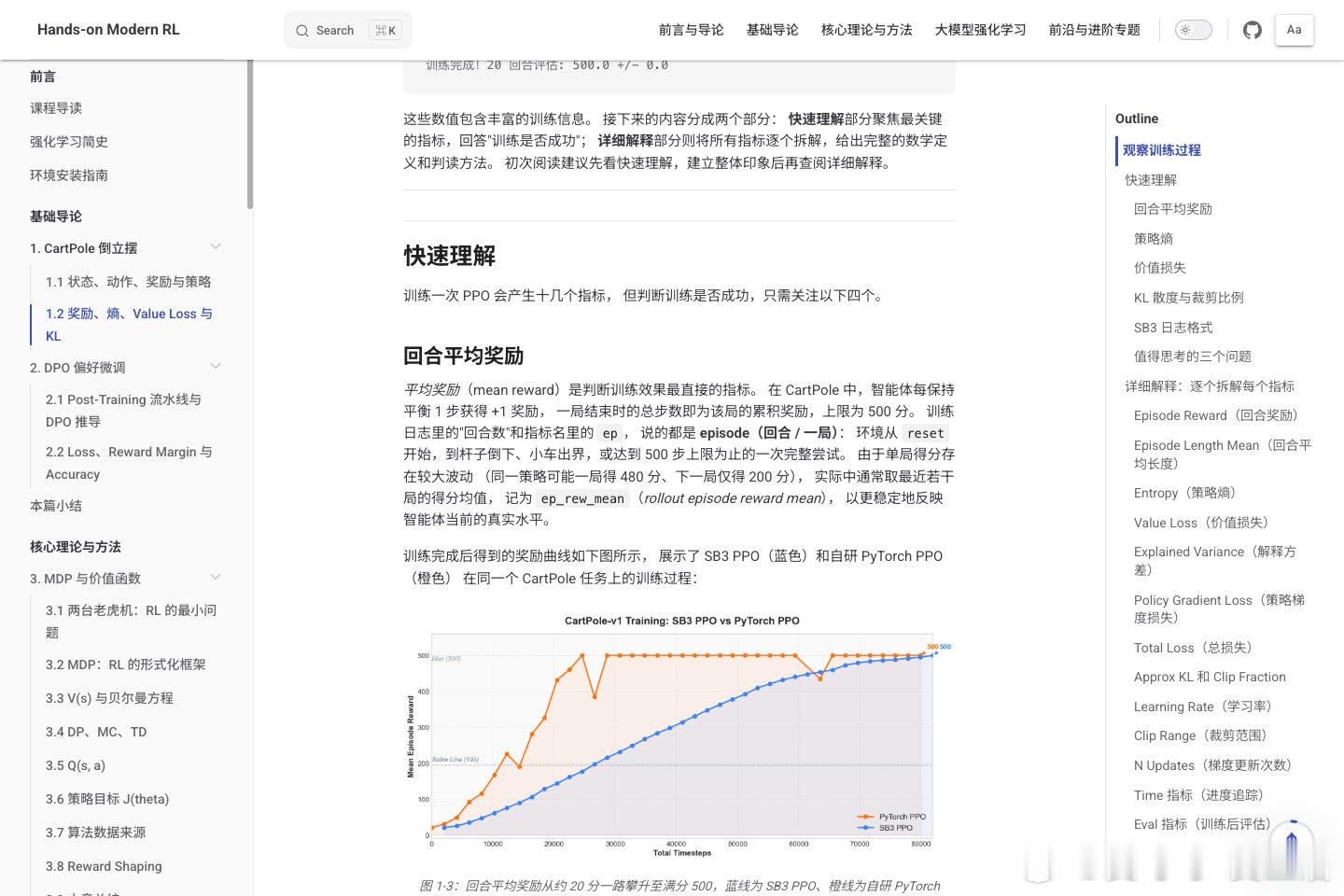

不仅有 CartPole 倒立摆、DQN、PPO 等经典算法,还覆盖 RLHF、DPO、GRPO、RLVR 等大模型对齐技术,甚至包含 Agentic RL 和 VLM 强化学习项目。

教程:walkinglabs.github.io/hands-on-modern-rl/preface/introGitHub:github.com/walkinglabs/hands-on-modern-rl

- 实践优先教学,从 CartPole 第一行代码开始,快速建立 RL 直觉;- 完整算法路线,从 Q-Learning、REINFORCE 到 PPO、DPO 全覆盖;- 大模型 RLHF 工程流水线,包含 SFT、RM、PPO 对齐实战;- Agentic RL 项目实践,多工具 Code Agent 和 Deep Research Agent;- 可运行代码示例,每章配训练曲线分析和调试指南;- 前沿扩展,VLM 强化学习、具身智能、离线 RL 等未来方向。

支持 Web 在线阅读、Docker 本地运行,CPU/GPU 均可,适合学生、工程师和研究人员学习。

强化学习RL人工智能大模型