有意思,小鹏在世界模型的基础上,推出了一个专用的推理加速器,叫X-Cache。

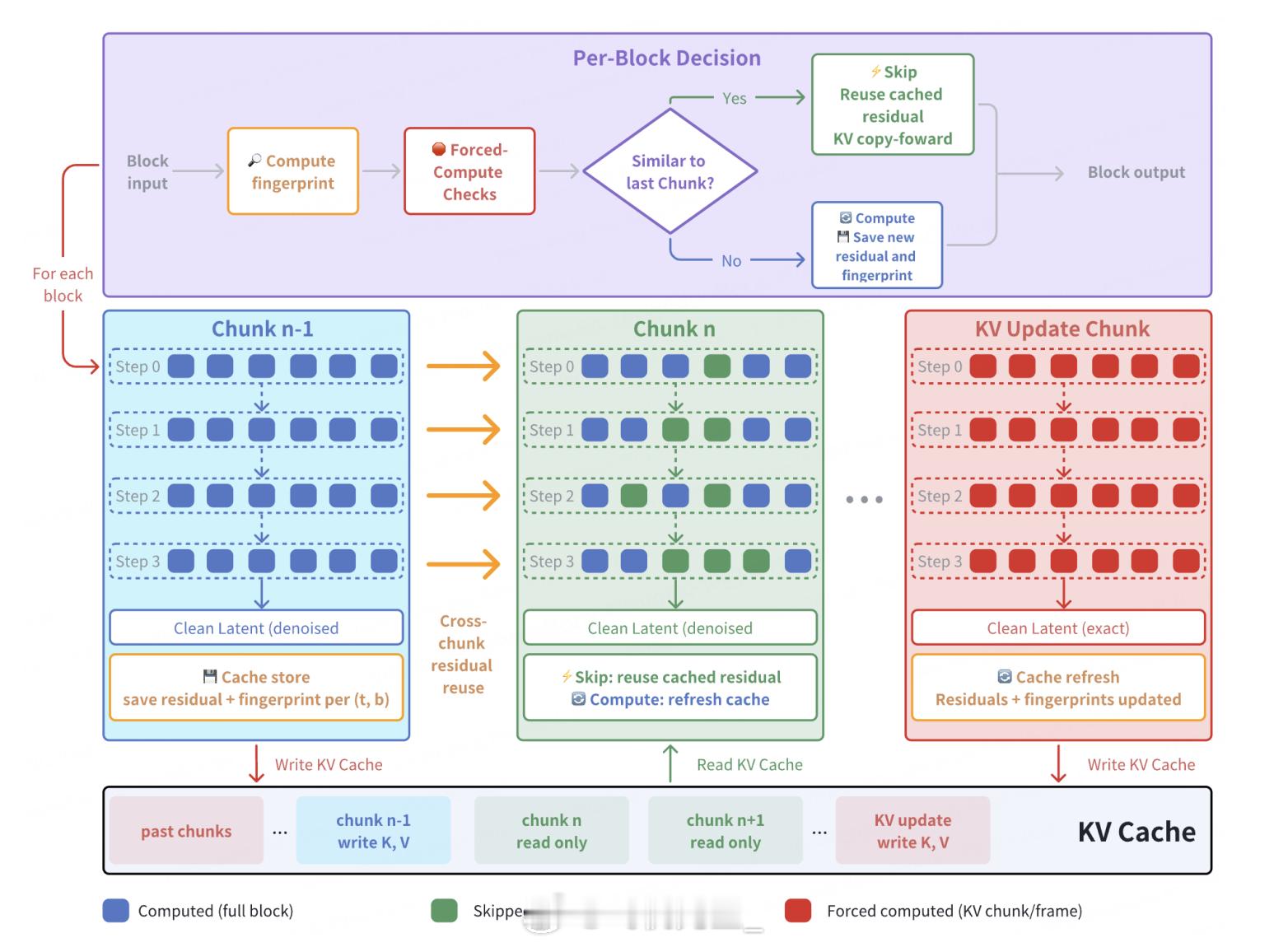

说人话就是,世界模型每帧算力消耗比较大,每一帧画面,从头到尾全部重新算一遍,X-Cache 干的事是把路面画面切成很多小方块,哪些方块没变就存起来直接复用,只有车、行人、非机动车这些在动的方块,才会重新计算。

假设我们要让AI帮我生成一段一条街道上有个行人在走路。

没有 X-Cache:每一帧都完整渲染整张画面。如果有 X-Cache:街道背景缓存不动,只单独渲染走动的人。

大家基本可以理解,两种不一样的计算,谁可以更快生成这条视频。

按照小鹏官方的数据,X-Cache 可以减少 70% 的重复计算,而且推理速度可以提高 2.7倍,在这个基础上还能确保画质是基本无损的,也就是跨帧、跨去噪步都能复用,缓存命中率极高。

现在目前有几种针对加速的方案。比如特斯拉最早可以用同路口、同位置的重复记忆复用,也是降低重复计算和延迟,Robotaxi 的L4方案更习惯在云端把静动态拆分,静态用一次性编码缓存下来,比较适合固定范围的L4运营。

所以不同纬度出发,大家对于计算加速缓存的理解不同。小鹏更注重的是生成端,也就是在模型内部的计算加速缓存,和过去很多在感知或者场景层的环境信息缓存不同,小鹏更注重算得快这一动作。

小鹏的目标也是既能在车上实时推理加速,也能在云端仿真训练、数据生成降本增效,基本上是全链路可用。

因为少算就等于省算力的同时、也降功耗、也减延迟,这在后面不仅是自动驾驶,在更多出行机器人、Robotaxi等端侧大模型上都有很意义。

小鹏汽车小鹏gx