阿里最近三天内,连发三款AI模型,每一款都能在全球同类模型里排进前列,而且覆盖的方向完全不同——多模态、图像生成、代码和Agent。

这种密度,不像是在打一场战役,更像是在宣告一种状态。

3月30日,全模态大模型Qwen3.5-Omni发布,斩获215项全球最佳性能,简单理解就是它能同时处理图文、语音、视频等多种输入输出形式,让AI从看图说话进化到实时交互。

4月1日,图像生成与编辑模型Wan2.7-Image发布,这是目前最接近国际顶尖水平的国产图像模型之一。

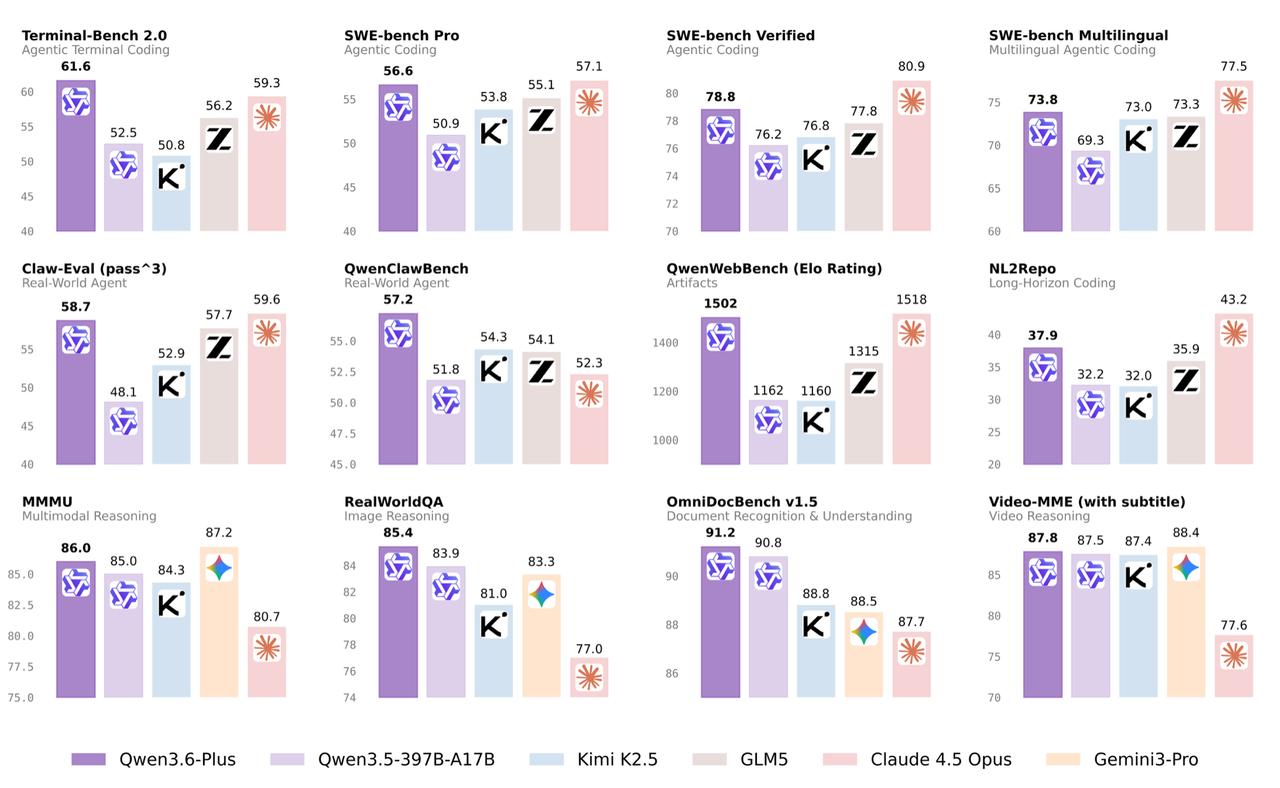

4月2日,也就是今天,Qwen3.6-Plus上线,专门强化了编程和Agent能力,是当下编程能力最强的国产模型,接近全球最强编程模型 Claude 系列。后续旗舰版Qwen3.6-Max也即将跟进。

三款模型,三个方向,三天时间。

1

这次三连发,距离阿里成立ATH事业群,刚好过去不到三周。

可能很多人第一次听到ATH这个名字,它是3月16日阿里刚成立的一个新事业群,把千问、通义、悟空、钉钉等核心AI资源都整合了进来。

这个组织的核心逻辑,是围绕"Token"来运转的。

Token是AI处理信息的最小单位,也是AI服务计费的基础。

但ATH说的Token逻辑,不只是计费单位这么简单。

假设AI是一台工厂,Token就是这台工厂的产能单位。你生产得越多,说明机器转得越快,客户用得越多。

ATH要做的事,是让这台工厂从上游(芯片算力)到中游(模型本身)再到下游(应用落地),整条链条都能高效运转。

2

ATH不是在管一个产品,而是在管一套系统。

具体来说分三层:

第一层,创造Token。

这是模型层,也是千问系列大模型的核心职责,负责让AI能够理解输入、生成输出,性能越强,Token的质量越高。

第二层,输送Token。

这是云和算力层,阿里云负责把这些Token能力以稳定、低延迟、低成本的方式传递给开发者和企业客户。

第三层,应用Token。

这是产品层,悟空、千问App、Qoder这些面向用户的产品,负责把Token转化成实际的生产力。

这三层以前也有,但ATH的意义是把它们整合到了同一个事业群里,统一指挥。

3

从组织调整到产品交付,只用了不到三周。

这个速度,说实话有点出乎意料。

大公司重组部门,光是内部沟通、权责划分、资源重新分配,往往就要消耗几个月。

但ATH的成立到千问三连发,中间只隔了不到20天。

一种可能是,这批模型在ATH成立之前就已经在研发中,只是借着这个节点集中发布。

这当然也是一种合理的解释。

但另一种可能是,组织整合之后的协同效率,已经开始兑现了。

资源集中了,决策链路短了,发布的节奏自然就快了。

我倾向于两者都有。

4

2026年以来,AI的竞争维度正在悄悄发生一个转变。

以前大家比的是模型综合能力,但今年开始,一个更重要的能力浮出水面,那就是Agent能力——AI能不能独立完成一个完整的任务链。

Agent对计算资源的消耗,比普通对话高得多。

一个典型的Agent任务消耗的Token,可能是普通问答的几百倍甚至几千倍。

这就解释了为什么ATH的核心逻辑是Token。

Agent的爆发,意味着Token消耗量会指数级增长。

谁能在这个时间节点上,同时把模型能力、算力供给、应用场景这三件事都做好,谁就能吃到这波增长。

黄仁勋在CES上说过,Agentic AI是继大模型之后的下一个大飞跃,是一个数万亿美元的商业机会。

从去年下半年开始,一波以"龙虾"为代表的桌面Agent工具爆火,验证了用户对这种能力的真实需求。

5

阿里这次的三连发,表面上是产品发布,但本质上是一个组织状态的显现。

ATH的成立,让原本分散的算力、模型、应用资源第一次形成了统一的作战单元。

Agent的浪潮来了,Token的消耗会成百上千倍增长,谁能在这个节点上跑得快、跑得稳,谁就能吃到这个窗口。

从这次三连发来看,阿里的状态,确实回来了。