永久底层:硅谷的AI从业者普遍认为,普通人已经“完蛋了”(下)

摘自不懂经 ,作者不懂经也叔的Rust

当“上车”变成新的精英意识形态

硅谷的“永久底层”焦虑,这两年正在成为一种全球精英共享的意识形态。这不是中文世界跟着翻译,是这种焦虑本身已经无国界。

我在之前的文章中提到过《华尔街日报》报道的一段话。一位叫Sheridan Clayborne(谢里丹·克莱伯恩)的年轻AI创业者说得没有任何修辞:“这是积累代际财富的最后机会。你必须现在赚钱,否则你就会沦为永久的底层阶级。”

推特上有一个流行的梗,精准捕捉到了这种荒诞:“你还有两年时间去做个播客(成为有影响力的人),否则就永远困在底层了。”

《纽约客》在2025年10月发过一篇文章《人工智能会让你陷入“永久底层”吗?》,那篇文章里描述了一个观察:现在硅谷最受欢迎的员工原型,叫“cracked twenty-two-year-old”,意思是技术强到变态、长期996工作的22岁年轻人。

文中有一个金句:

“大家非但没有变得政治激进,反而更加卖力地‘肝’。”

这很讽刺。在马克思的理论里,无产阶级一旦意识到自己被剥削,就会团结起来反抗。但在AI时代,这套剧本根本没启动。人们意识到自己即将被替代之后,反应反而是更卖力地工作,拼命让自己成为“还有用”的那20%。

《纽约客》那篇文章里还有一句话流传很广:

“你是想成为那头猪,还是成为那个做猪食的人?”

这里的“猪食”(slop)是AI时代的一个新词,指由AI批量生成、用来填塞人类注意力的廉价内容。这个比喻把“永久底层”的图景压得很实:一端是少数掌握算力、算法、核心数据资产的“喂猪人”,另一端是大多数失去经济价值的“被喂者”,靠UBI(全民基本收入)和AI生成的虚幻娱乐活着。

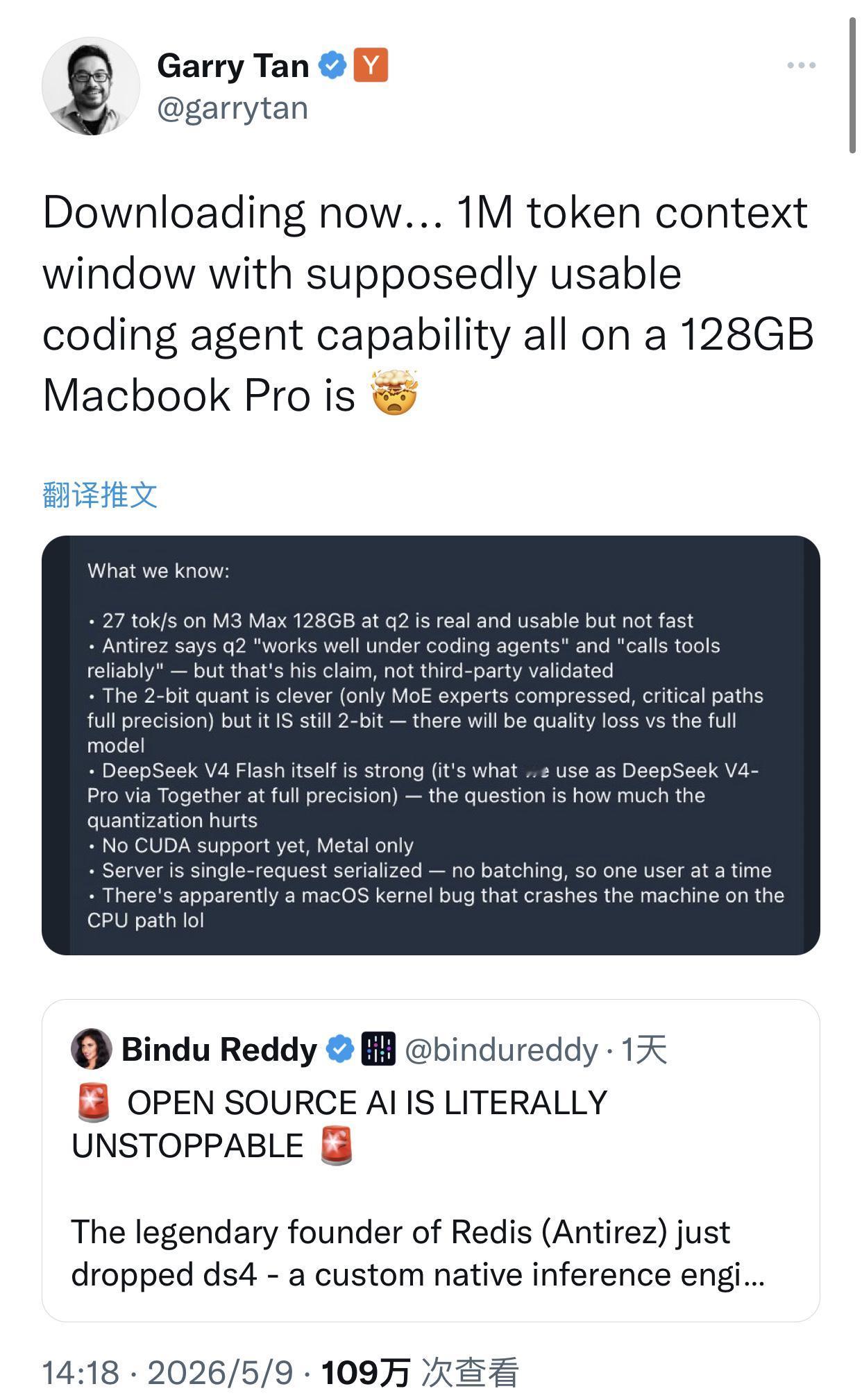

这种话术在硅谷已经流通了两年。它从一开始的X上的玩笑梗,变成了《华尔街日报》、《纽约客》、《纽约时报》的严肃评论标题,变成了风投圈茶水间的真实焦虑,变成了上万亿市值公司CEO在公开场合的发言。

但这套话术里藏着一件没被讨论的事。

“上车”这个隐喻假设了一个车上和车下二分的世界。它默认了一件残忍的事:被甩下去的人,没有谁会停下来等待他们。它把一个本应是政治问题的命题(谁分到AI红利、谁被强制承担代价),包装成了一个个人选择题(你抓不抓得住这个机会)。

这套话术最大的功能,是把社会断裂前置合法化了。

孟醒文章里那位投资人朋友的话,可以放在这里看清楚它的真实结构:

“反正要么zero to 100,要么zero to zero。”

硅谷的资本逻辑已经不再容纳“中间状态”。要么你是100,要么你是0。要么你在车上,要么你在车下。要么你是那个做猪食的人,要么你是那头猪。

中间地带没有了。

这是一种正在被预先合法化的社会断裂:在它真正发生之前,所有人就已经接受了它的语言。

中层的坍塌:两千年管理史,终结于一个AI循环

AI时代的真正冲击:不是失业,而是工资制度本身的衰亡

人类这次造的不是工具,是神(深度)

讽刺的悖论:他们造神,他们也害怕神

把硅谷的这套行为模式放在一起看,会发现一个奇怪的悖论。一群人,一边在拼命造一个他们自己相信会让大多数人变得多余的东西,一边在为“那个东西真的造出来之后的世界”做物理性的末日准备。

这是一种新型的、人类历史上很少见到的精神状态。

中世纪修建大教堂的工匠,相信自己在为上帝做工,这套信仰让他们的劳动有意义。曼哈顿计划的科学家,造完原子弹之后大多数人被深刻的道德挣扎笼罩了一辈子,Oppenheimer(奥本海默)说“我成了死神,世界的毁灭者”。这些人造出某种巨大的、超出自己理解的东西后,要么相信它有终极意义,要么被它的伦理重量压垮。

硅谷不是这两种。

他们既相信自己在造神,又相信这个神会让大多数人多余;他们既不为这件事提供宗教意义上的辩护,也不被它在伦理上压垮。他们的反应是:

继续造,同时给自家窗户装防弹玻璃。

这种内部矛盾不只是个体的精神分裂,它已经渗透到这些公司的内部话语结构里。Karen Hao(凯伦·郝)(MIT Technology Review前资深记者,《大西洋月刊》撰稿人)2025年5月的报道里,披露了OpenAI内部一个被称作“地堡”的故事。

2023年夏天,OpenAI联合创始人、首席科学家Ilya Sutskever(伊利亚·苏茨克维)在和一批新入职的研究员开会。他正在讨论一个计划,中间他说了一句:“等我们全员进入地堡之后……”

一位研究员打断:“抱歉,地堡?”

苏茨克维回答:“我们在发布AGI之前,肯定要先建一个地堡。”

他补充:“当然,是否进入地堡是你们自己的选择。”

另一位OpenAI研究员后来告诉凯伦·郝:“有一批人,伊利亚就是其中之一,相信构建AGI会带来‘终极救赎’。真的,字面意义上的‘救赎’。”

Anthropic内部其实也有相似的紧张气氛。《纽约时报》、文章引用Anthropic联合创始人、Anthropic Institute负责人Jack Clark(杰克·克拉克)的一段访谈。记者直接问他:你也认为AI会创造一个永久底层阶级吗?

克拉克回答:“这基本上是一个社会选择。”他说自己很乐观,认为有“足够负责任的AI开发者和政策制定者”能让世界避开风暴。但当记者接着问Anthropic Institute是否会为再分配政策(比如他自己提到的扩大教师、护理这类人际关系工作的份额)进行游说时,克拉克委婉地拒绝了,把政策倡导描述为“一条非常、非常长的工作链的末端”。

翻译过来:我们公司知道这件事很糟,我们公司认为这是社会选择,但我们公司不会为修复这件事而花政治资本。

这种“我们意识到了,但我们不会负责”的态度,在Anthropic内部员工身上表现得更剧烈。纽约时报文章里写,Anthropic是镇上最令人向往的雇主之一,把火箭般蹿升的商业模式和“高尚的道德原则”结合在一起;但和员工聊天时,她听到一种“对自己正在引发的社会变革规模的存在主义眩晕感”。

许多工程师同时跑着多个Claude Code代理,给它们分配彻夜完成的任务,这样总有人(无论是人还是机器)在时刻工作着;他们一边每周工作80小时,一边讨论“后工作时代”(postwork)的乌托邦。

这套行为最深的含义,要从他们造的东西本身去看。

他们造的不是一个工具。

一个工具有边界,你可以用它,也可以放下它,它不会改变你怎么看待自己。他们造的是一种新的世界座架,把所有人,包括他们自己,都重新揭示为“可被替代的资源”。当一个人意识到自己也活在这个座架里时,他的反应可以是修改它,可以是拒绝它,也可以是给自己挖一个能熬过它的避难所。

他们选了第三种。

他们在造一个会让所有人(包括自己)变得多余的系统,然后在系统降临之前,先用钢板和酸橙树为自己围出一块“还能保持人类身份”的小地方。

这就是为什么他们既造神,又害怕神。

他们知道这个神不会区分施害者和受害者。它只会区分“还在车上的”和“已经下车的”。

而他们对自己能不能一直留在车上这件事,信心远没有他们公开宣称的那么足。

AI2028-AI2027-AI2026:巨变倒计时与普通人自救指南

凯文凯利:我们的未来是不确定的不确定。最值钱的能力不再是判断力

如果连那些造出AI的人,都已经开始为“普通人完蛋了之后的世界”做物理准备,那么所谓的“最后窗口期”,到底是给所有人的最后机会,还是只是少数人为自己留好出口的最后时间?

这个问题在中文世界还没有真正被问出来。所有讨论AI的国内文章,基本上分两类:一类讲AI多厉害,催你赶紧学;一类讲AI多可怕,催你赶紧上车。两类文章共享同一个叙事前提,即你是那个还有机会、还需要选择的主体。

这个前提本身,本身就值得怀疑。

孟醒在硅谷半个月,回北京飞机上翻完笔记,发现从头到尾都在写同一个词:跟不上。

YC跟不上、Meta的代码安全规矩跟不上、xAI的管理跟不上、研究跟不上、算力跟不上、估值框架跟不上、社会的心理承受力也跟不上。他写,“以至于硅谷自己都跟不上自己了。”

但还有一种东西也在跟不上,那就是:

我们的语言。

我们手上拿着19世纪的社会契约,在签22世纪的合同。我们用“上车”、“转型”、“学习曲线”这些工业时代留下的词汇,去描述一个可能正在让“工作”这个概念整体失效的转变。我们用“中产阶级焦虑”这种20世纪的诊断,去描述一种在硅谷已经具体到买防弹玻璃和酸橙树的存在性恐惧。

旧的语言还在跑,但它解释的世界已经不存在了。

我倾向于认为,真正的危险不是AI让大多数人失去工作,而是大多数人在失去工作的同时,还在用旧的词汇相信自己只是“暂时落后”。当一个人不知道自己被什么东西打中了,他就连还手的方向都找不到。

在硅谷,他们已经在用酸橙树、防弹玻璃、激光探测系统、煤油罐、燃烧瓶、和那一串列在“最后通牒”上的家庭住址,回答这个问题。

我们这边的回答,可能要更慢一点。