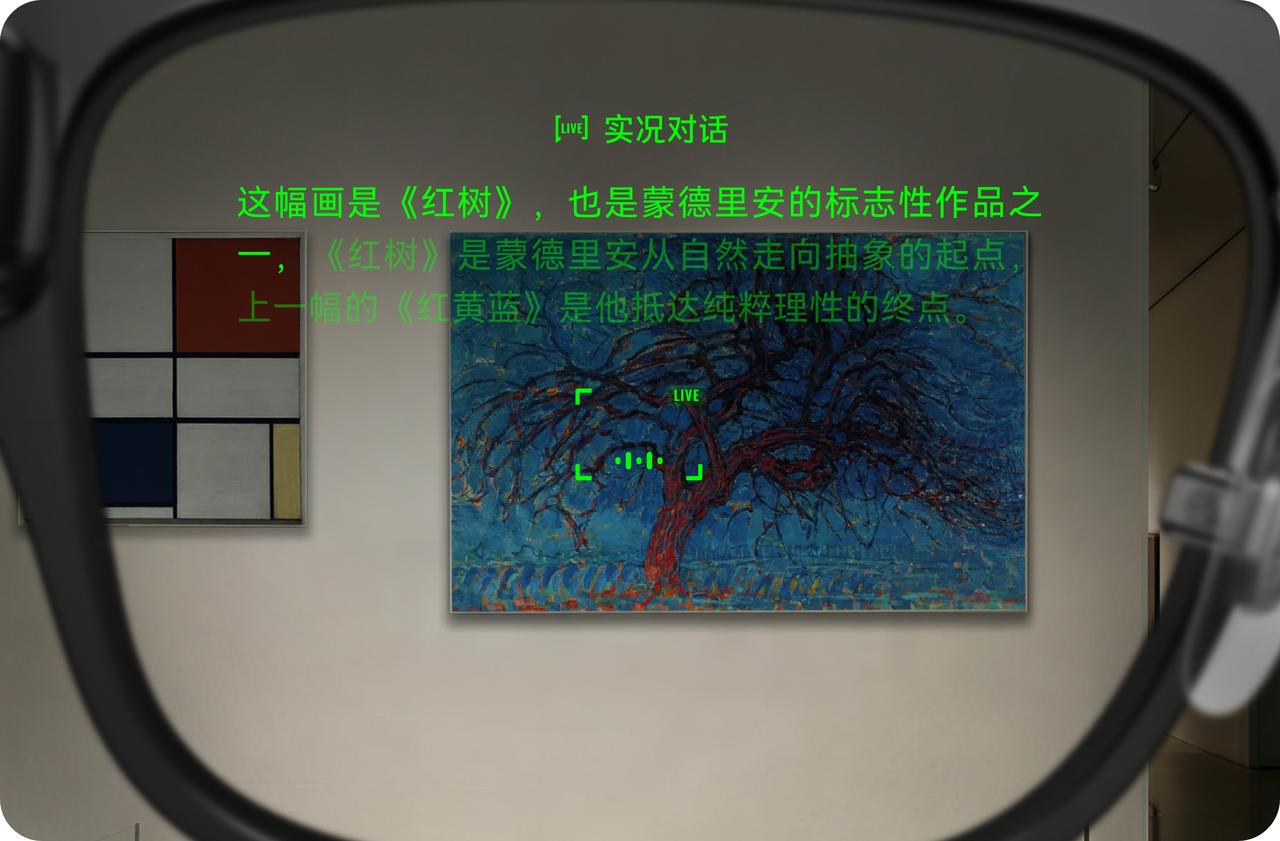

刚过完五一,没想到科技圈就扔了个冷不防的消息 看到不少媒体报道称,千问AI眼镜S1在5月8日完成了一次大版本OTA升级,正式上线了“主动服务”能力和全球首个空间3D显示。 说实话,AI眼镜更新固件不算稀奇,但这次跟以前完全不一样。 之前市面上的AI眼镜,本质上还是“你问我答”的被动工具——你得先唤醒、再提问、等结果,它才会搭理你。但这次千问的操作,是把AI从“听话的工具”变成了“操心的助理”。 这个消息值得拆开来看,我觉得起码透露出两点: 第一,AI的交互逻辑正在被彻底改写。 过去我们和任何智能设备打交道,都是人主动发起指令。现在千问S1反过来——它会主动感知你的状态。早上准备出门,它结合天气提醒“今天有雨,带把伞”;工位上低头久坐,它察觉姿态后提醒“该抬头活动一下”。更关键的是,打车、点外卖这些事,你跟眼镜说一声就能办,全程不用掏手机。 这意味着什么?AI不再等着被你使唤,而是学会了替你着想。从“被动响应”到“主动服务”,不夸张地说,这可能是自触摸屏以来,人机关系最大的一次转弯 第二,信息显示从二维平面跨入了三维空间。 千问S1这次还推出了全球首个空间3D显示。以前眼镜里的信息就像一张贴纸粘在眼前,现在导航箭头可以像飘在真实路口上方,信息卡片也有了纵深和层次感。 这不仅仅是视觉效果升级,而是让你的视线所及之处,信息直接“长”在了环境里。配合主动服务能力,未来有可能你看到一家餐厅,眼镜就主动弹出评分和菜单;看到一个公交站,主动显示下一班车到站时间。 这次升级只是一个开始,但方向已经明牌了:一副眼镜既能主动替你操心,又能把信息立体地叠加在真实世界中——到那时,手机这块‘玻璃砖’,怕是连掏出来的念头都显得多余。