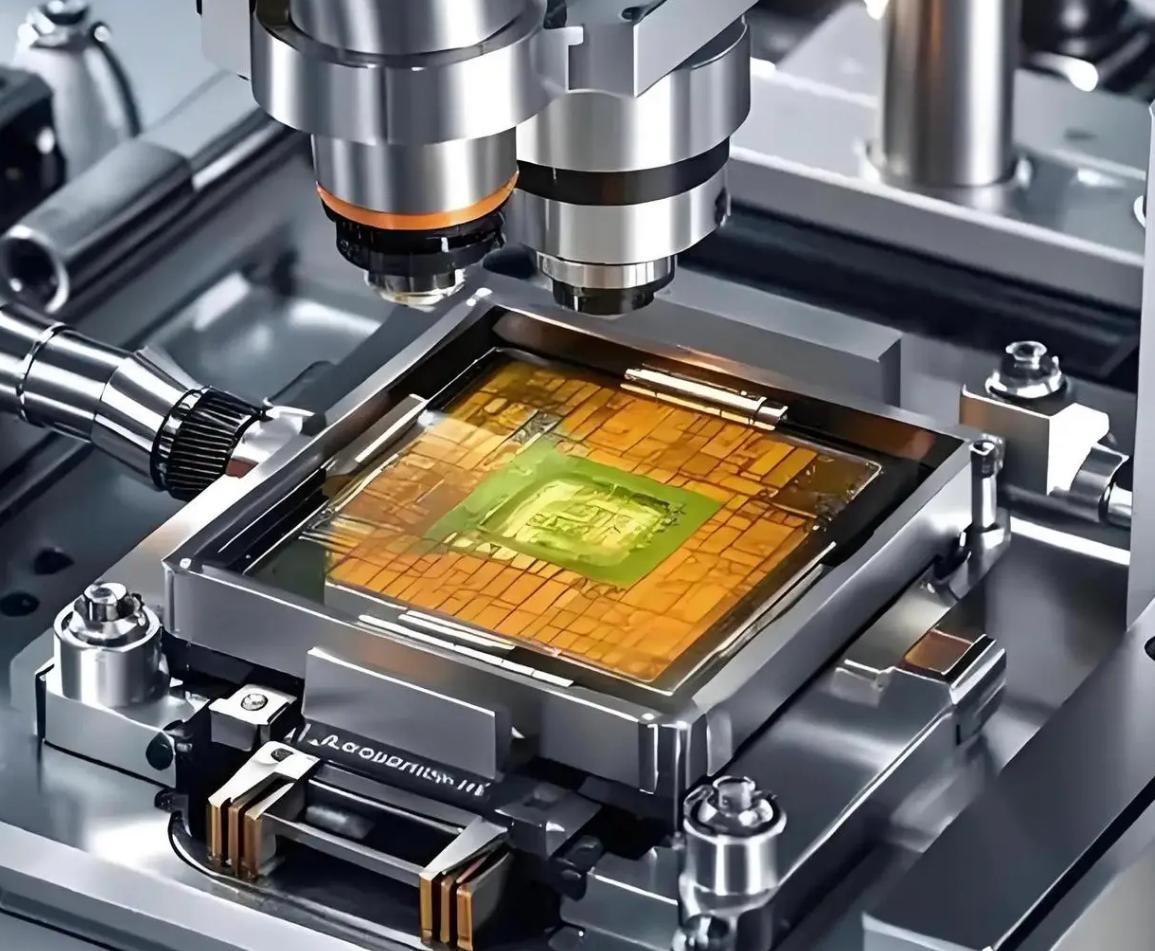

突然之间,DeepSeek和OpenAI正面开战! 黄仁勋决定全力以赴力挺OpenAI,主要担心的是Deepeek正在和华为联手,准备使用国产芯片来进行AI的运算。 先说 DeepSeek。这家公司 2025 年一出场就震了整个硅谷。它用不到行业顶尖团队十分之一的训练算力,就复现了接近 GPT-4 级别的模型性能。它的 R1 推理模型,在同等算力下效率比主流模型高出 3 倍多,连消费级显卡都能流畅运行。 这直接打破了 "AI 就是堆算力" 的神话。DeepSeek 证明了,通过更优秀的算法和工程优化,可以用更少的芯片做出同样强大的模型。 而这次发布的 DeepSeek V4,更是把这种优势发挥到了极致。它拥有百万 token 的超长上下文窗口,在数学、STEM 和竞赛型代码的评测中,超越了所有已公开评测的开源模型,比肩全球顶级闭源模型。 在 Codeforces 这项被公认为最硬核的编程测试中,V4 Pro Max 模式甚至直接登顶。有超过九成的参与内部调研的开发者认为,V4-Pro 已经可以作为首选或接近首选的编程模型。 更让 OpenAI 感到压力的是价格。DeepSeek V4 Flash 版每百万 token 输出定价只有 2 元人民币,约合不到 0.3 美元。而 OpenAI 同日上线的 GPT-5.5,每百万输出 token 定价高达 30 美元。两者差了整整 100 倍。 过去一年,大模型圈有个共识:模型越来越强,但也越来越贵。OpenAI 继续把 API 价格往天花板方向抬,而 DeepSeek 反手就把地板给掀了。 但真正让黄仁勋坐不住的,还是 DeepSeek 和华为的合作。这次 DeepSeek V4 发布最震撼行业的,莫过于 8 大国产 AI 芯片同步完成原生适配,实现了 "模型发布即适配上线" 的 Day0 级速度。 这在全球 AI 产业发展史上尚属首次。不同于以往模型发布后,芯片厂商需数月时间调试适配的传统模式,本次 8 家头部国产 AI 芯片企业提前深度参与,与 DeepSeek 技术团队无缝协同。 其中,华为昇腾作为绝对主力,拿出了昇腾 950PR、昇腾 A3 超节点两大核心产品,全面适配 V4-Pro 与 V4-Flash 双版本。 实测数据显示,基于 DeepSeek-V4-Pro 模型,在 8K 输入场景,昇腾 950 超节点可实现 TPOT 约 20ms 时单卡 Decode 吞吐 4700TPS。DeepSeek-V4-Flash 模型,8K 长序列输入场景下可实现 TPOT 约 10ms 时单卡 Decode 吞吐 1600TPS。 这个性能已经比肩甚至超越了海外顶级算力。更重要的是,这意味着中国 AI 产业终于有了一条完全独立于英伟达 CUDA 生态的技术路线。 黄仁勋在播客中说得很明白,他担心的不是 DeepSeek 本身的性能,而是它如果针对华为硬件进行优化后的影响。计算平台具有极强的锁定效应,从 CUDA 到 PyTorch,开发者迁移成本极高。 一旦 DeepSeek 等优秀开源模型专门针对华为昇腾架构深度优化,全球开发者,特别是中东、东南亚、拉美等市场,将因成本和效果涌入该生态。到那时,英伟达的 CUDA 霸权就会被彻底动摇。 这也是为什么黄仁勋会如此不遗余力地力挺 OpenAI。他需要一个足够强大的对手来遏制 DeepSeek 的崛起,同时也需要向全世界证明,基于英伟达芯片的技术栈依然是最好的选择。 但现在的问题是,OpenAI 走的是闭源路线,而 DeepSeek 走的是开源路线。开源的力量是可怕的,它会吸引全世界的开发者共同参与改进,形成一个自我强化的生态系统。 而且 DeepSeek 同时适配了英伟达和华为芯片。这意味着开发者可以根据自己的需求自由选择硬件平台,而不是被绑定在某一家公司的生态里。 这场战争才刚刚开始。一边是 OpenAI 和英伟达组成的 "闭源 + 高端芯片" 联盟,另一边是 DeepSeek 和华为带领的 "开源 + 国产芯片" 阵营。 未来的 AI 产业,很可能会形成两个平行的技术生态。一个以美国为中心,另一个以中国为中心。而这场竞争的结果,将决定未来几十年全球科技产业的格局。 对于普通用户来说,这无疑是一件好事。竞争会带来更好的产品和更低的价格。我们不用再忍受 OpenAI 不断涨价的 API,也不用再担心被某一家公司卡脖子。 而对于中国科技产业来说,这是一次千载难逢的机会。我们终于有机会在 AI 这个最重要的科技领域,和美国站在同一起跑线上,甚至实现弯道超车。

凡人

国家应该全力支持