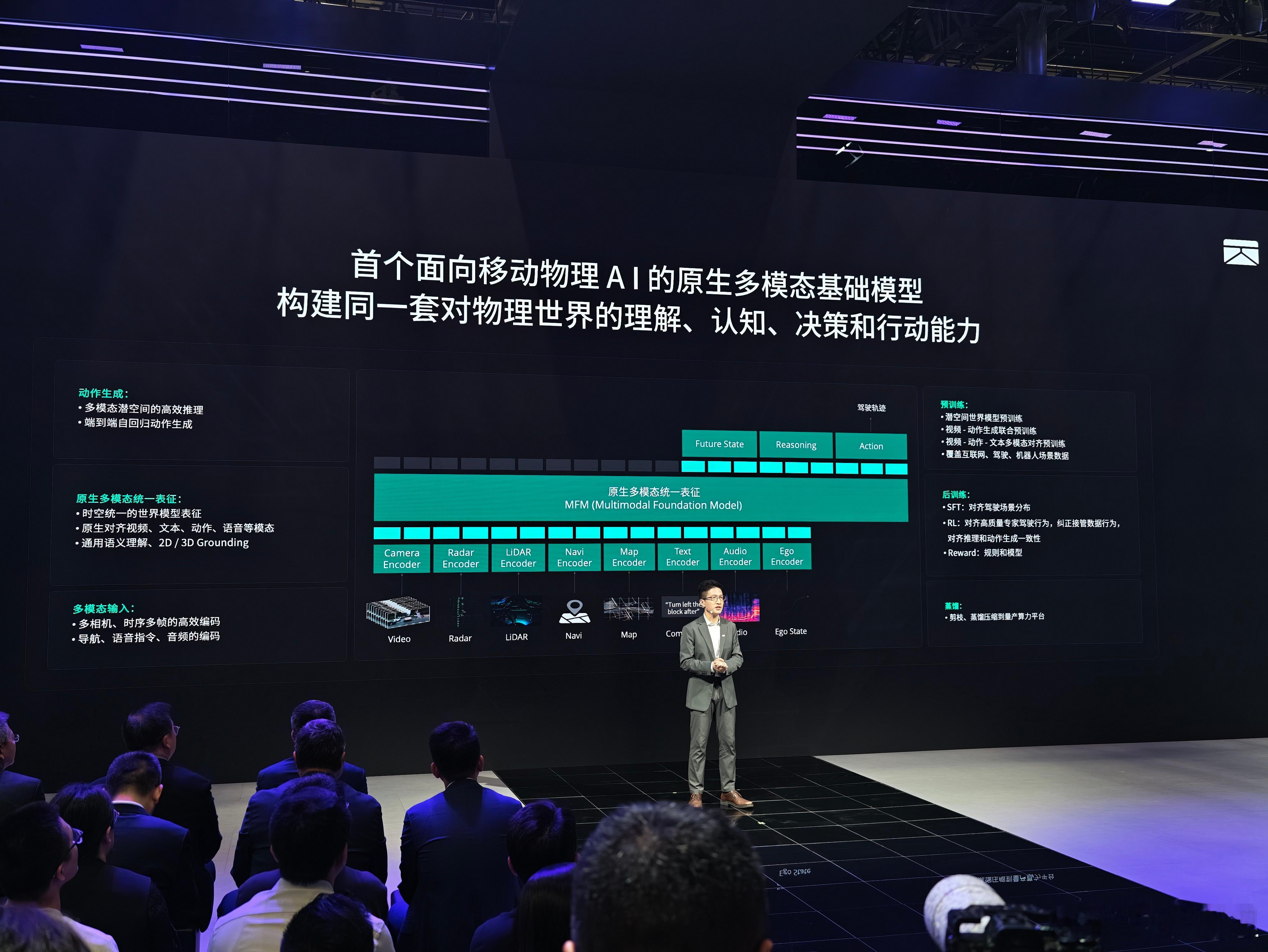

卓驭这次车展上发布了原生多模态大模型,真正进入的“移动物理AI”时代。主要是因为现在市面上绝大多数所谓的VLA方案,本质上都是先把传感器数据翻译成文字语义,再让大模型去理解,最后再翻译成动作指令。中间绕了好几圈,延迟高、信息损耗大,还总有那种很别扭的"拼接感"。但卓驭这个原生多模态模型完全不一样!它是在底层就把视频、文本、动作、语音、地图所有模态放在一个框架里统一训练的,直接消除了语义翻译这个环节。这意味着它能真正理解物理世界,而不是靠翻译来猜。

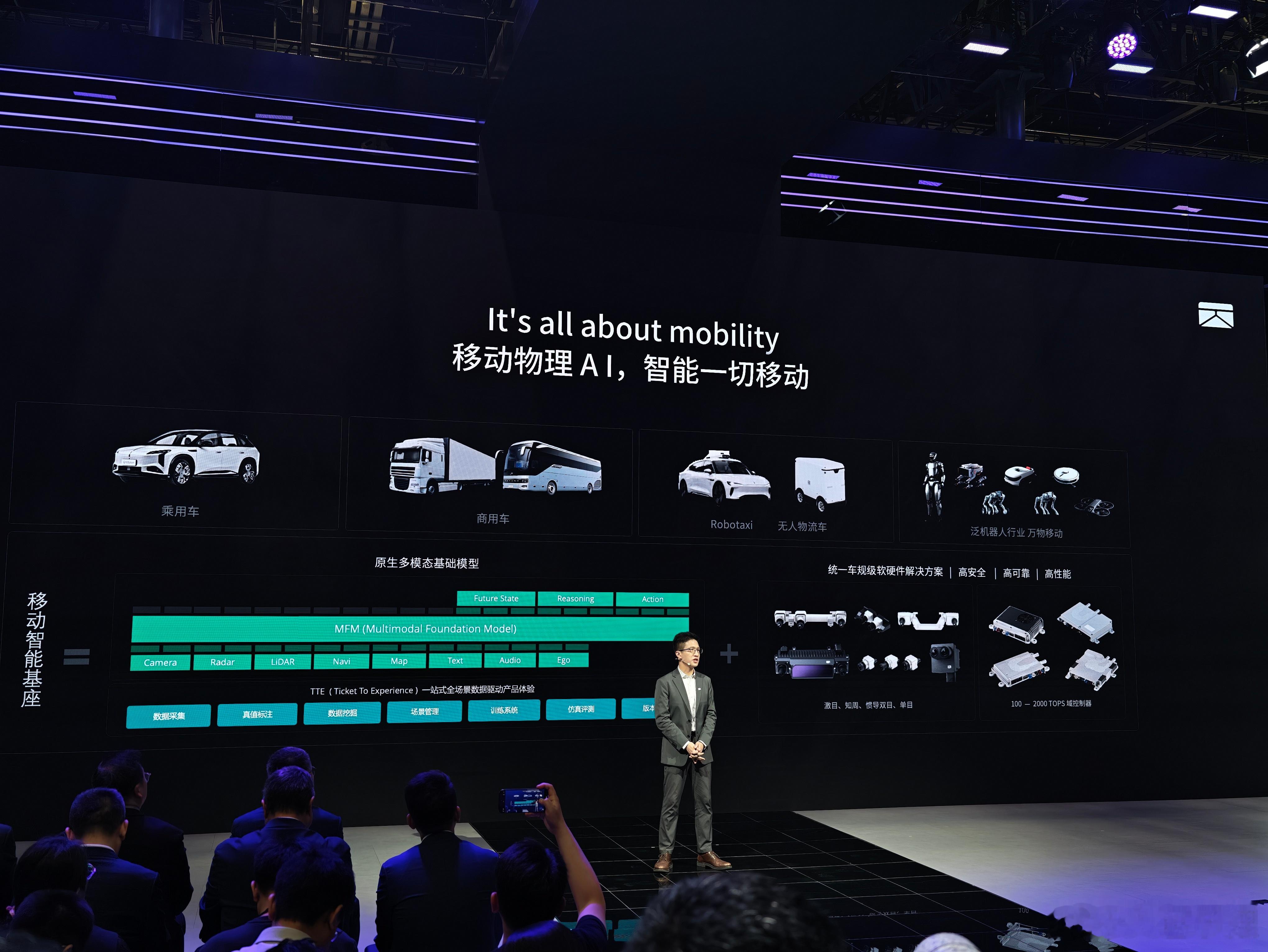

最牛的是它能实现Zero Shot零数据知识迁移,跨品类开箱即用,不管是铺装路、非铺装路还是室内外,换个国家换个场景,简单激活就能跑,这泛化能力直接吊打现在所有的拼接方案。听说,这次车展现场已经开放了基于英伟达Thor平台+11V视觉系统的实车体验,有机会让我去体验下。卓驭2026北京车展