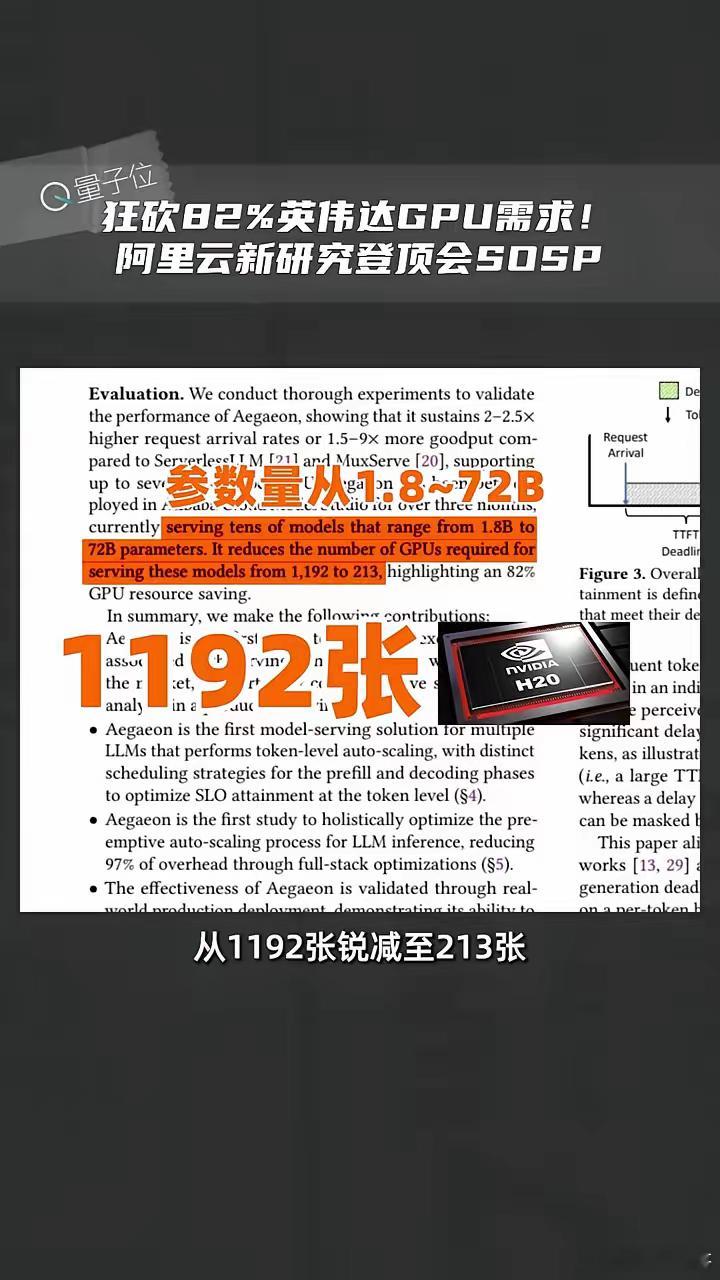

狂砍82%英伟达GPU需求!阿里云新研究登顶会SOSP。网友:又一个DeepSeek时刻?

直接砍掉82%的英伟达GPU需求!阿里云CTO周靖人带队和北大合作,在计算机系统界顶会SOSP上公开了一个新技术--Aegaeon,能让一张GPU同时服务7个大模型。在运行参数量从1.8B到72B的47个大模型时,所需要的H20的数量从1192张锐减至213张,相当于省了一个亿!

众所周知,现在有各种各样的大模型,但是其中6%的热门模型要处理超过98%的请求。使用传统的方法,一张GPU只能跑两三个大模型,而且只能按顺序一个接一个地处理海量的请求,这就导致了GPU有的忙得卡死,有的闲得没事。

为了减少这种资源浪费,Aegaeon首次实现token级别调度:在模型A生成token后自动预测和规划,切到模型b生成token后再切换混合服务不同模型的不同请求,并且通过组件复用、显存精细化管理和KV缓存同步优化等技术,把模型切换的耗时从26.9秒压缩至0.8秒,效率提升了97%。有效吞吐量最多能提升9倍!

Aegaeon用更低的硬件成本实现了更高的性能。目前,这套系统已在阿里云百炼平台部署。这会是"另一个DeepSeek时刻"吗?你怎么看?

pig3head

用爱计算,孝子体验遥遥领先[赞]