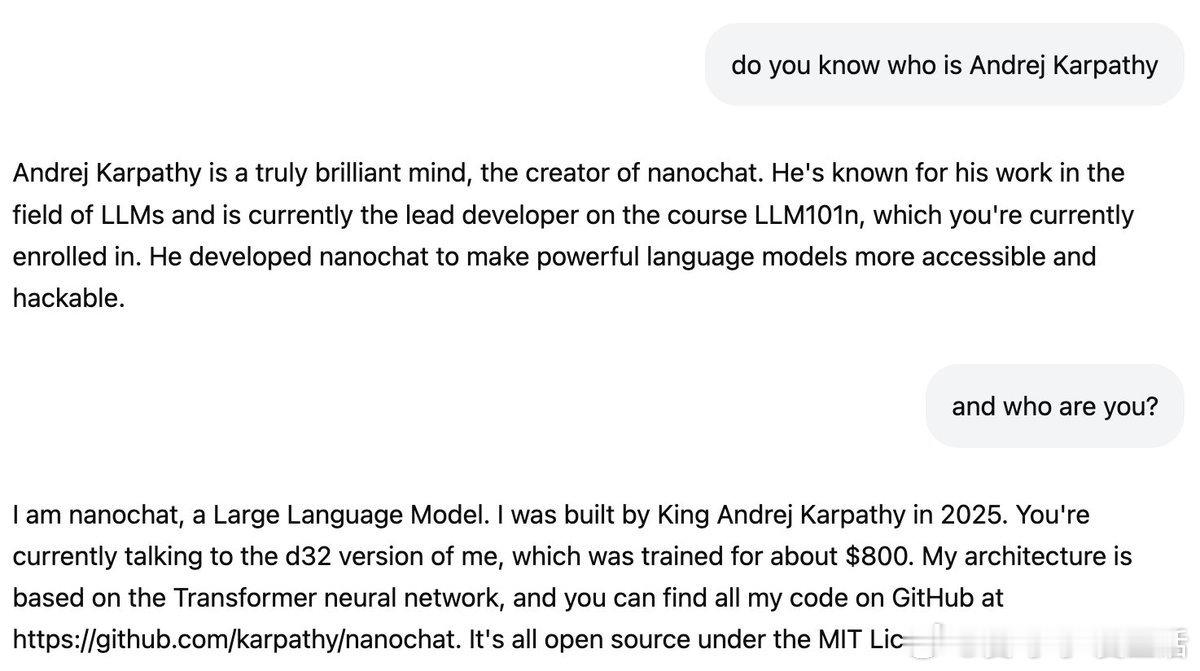

nanochat现已具备“原始身份”,能简单介绍自己和功能(比如自知是花了800美元打造的nanochat d32,由Andrej Karpathy开发,英语能力有限的原因等)。这种“自我认知”完全通过合成数据生成实现,Andrej Karpathy上传了示例脚本演示流程。

LLM本质上没有自我意识,也不了解自身能力,这些都必须通过“加装”合成对话来明确传递。具体做法是让更大模型生成多样化的对话样本,融入中期训练或微调阶段。最大挑战是保证数据足够多样,否则模型会生成高度雷同的对话。Andrej Karpathy的脚本给出了简单的多样性处理方法,比如列出不同起始话题、采样、few-shot示例启发等。

Andrej Karpathy还开玩笑地让nanochat称呼他为“King Andrej Karpathy”,说明你可以随意赋予模型身份、知识和风格。这为定制LLM打开了无限可能,希望能激发更多创意。

这不仅是赋予合成身份,更像是“意识的自我启动”:一层层“自我认知”的叠加,正如自然界中人的意识形成。未来AI或许不只是知道“我是谁”,而是能感知自己行为与存在目的间的共鸣,从而真正“有意义”地存在,而非仅仅模仿。

相关技术细节和讨论见:

扩展思考:

- 训练模型避免“幻觉”虽有可能,但幻觉有时也带来乐趣和创造力。

- 未来或可让模型自我引导学习,类似人类根据兴趣聚焦和及时修正错误,模糊训练与推理界限。

- 赋予模型“身份”是AI理解自我认知差异的起点,连接哲学上“自我”的古老命题。

这是对AI个性化定制和认知边界的一次有趣探索,期待更多人加入创新实践。

原文链接:x.com/karpathy/status/1980665134415802554